共计 9702 个字符,预计需要花费 25 分钟才能阅读完成。

(用户损失最大?

这并不能简单归结为谁的损失,而是 Claude 在策划更深远的战略。

最初,Cursor 就如同粘合剂,而现在的 Cursor2.0 已经具备了独立的编程模型。

然而,面对编程 AI 的需求,最为强大的依然是 GPT 与 Claude 这两位巨头。

TRAE 虽然不如 Cursor,但在 Claude 和 GPT 的支持下,同样能够获得一份蛋糕。

那是在 Claude Code 和 GPT5-Codex 尚未问世的时期。

如今,随着 Claude Code 和 GPT5-Codex 的推出,AI 编程开始依赖原生的大模型,逐步取代那些依赖包装和粘合的编程工具。

由于 GPT 目前面临资金问题,因此仍然会持续供给,只要它能保持独占并赚取更多利益,GPT 和 Gemini 将来也可能会停止供给。

不仅 Claude 在这个领域发力,GPT 也在争取主导地位。

Claude 的优势在于去除了地域限制,凭借自身实力,无需依赖其他编程产品进行推广。

完全可以自给自足。

AI 编程面临的最大挑战是 Token 成本过高。

无论如何,AI 编程都无法逃脱高昂的 Token 费用。

我从 Claude 的角度来看,Claude 在 11 月取得了显著进展,现在的 Claude Code 能够将 150K 的 Tokens 工作量直接降低到 2K,成本削减达到惊人的 98%!!!

最近我看到 Anthropic 发布的新技术指南,坦白说,读完第一遍我愣住了。

150,000 个 Tokens 降到 2,000,这不是简单的优化,而是一次彻底的降维打击啊!

这一降幅甚至比 Deepseek 的 3.2 降价还要夸张……

既然自己能做到,何必为别人做嫁衣呢?

毫不夸张地说,这可能是我在 2025 年看到的最出色的 AI Agent 优化方案。

说实话,我之前参与的多工具 Agent 项目,API 账单让我心惊胆战——一个月竟然高达 $360,000,这谁能承受得住?

现在 Anthropic 直接将费用降低到 $4,800,节省了 98.7% 的成本。

这还不是全部,响应时间也从 20 秒缩短至 5.5 秒。

传统方法把 AI 模型当作数据中转站,所有中间数据都要经过模型,这不是自寻死路吗?

Anthropic 这次直接将数据处理放入执行环境中,模型只负责生成代码和接收结果,决策层与执行层彻底分离。

看完之后,我总结了三个关键点:

- 环境内处理 – 中间数据完全不经过模型,Token 节省超过 99%

- MCP 代码 API 化 – Agent 如同程序员,所需工具自行导入

- 实打实的验证 – 不是纸上谈兵,生产环境月省 $355,200

做过多工具 Agent 的朋友都明白,现在的问题并非简单的优化可以解决,而是 架构性缺陷。

如果想要功能齐全,就必须依赖各种工具;要节省 Token,就只能削减功能。

这并不是两难选择,而是进入了死循环。

事实上,企业级 Agent 如果没有 50 到 200 个工具根本无法运转。

数据库查询、邮件发送、与 Salesforce 对接、Slack 协作、GitHub 集成,都是必备功能。

我之前的项目,光是工具接入就耗时两个月。

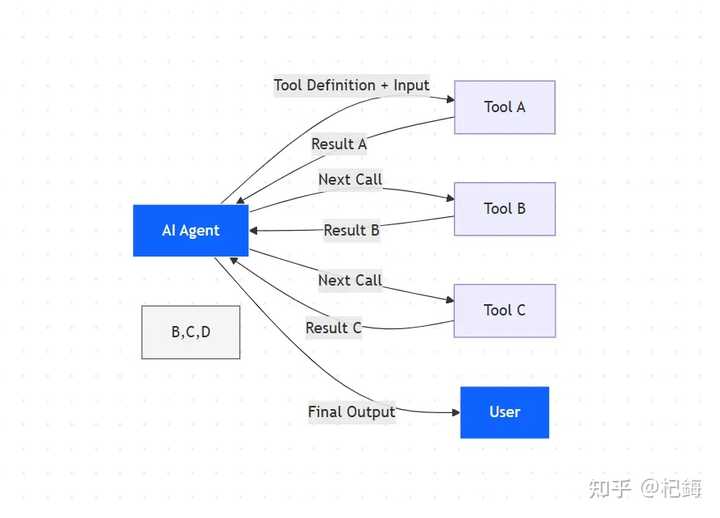

更棘手的是调用频率。

一个复杂的工作流往往需要进行 10 到 30 次的工具调用,链式依赖 的复杂性令人头痛——工具 A 的输出需要给工具 B,B 的输出又传给 C,每次都要在上下文中传递数据。

传统架构无法并行处理,只能串行执行,眼睁睁看着延迟不断增加。

调用次数与成本的关系如下:

| 任务复杂度 | 调用次数 | 数据量 | Token 消耗 |

|---|---|---|---|

| 简单任务 | 3- 5 次 | <1KB | 2K-5K |

| 中等任务 | 10-15 次 | 10-50KB | 20K-50K |

| 复杂任务 | 20-50 次 | 100-500KB | 100K-500K |

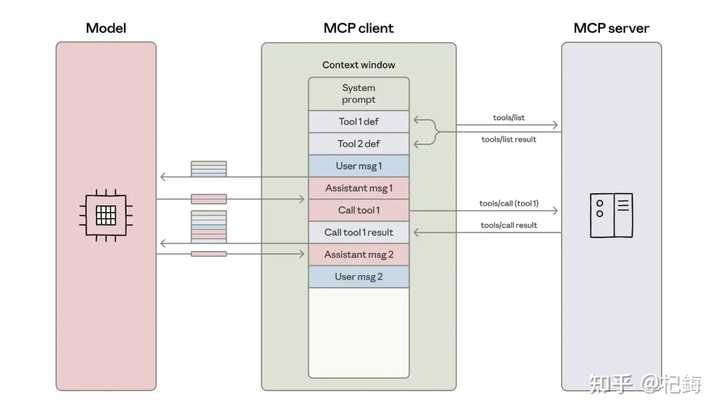

MCP (Model Context Protocol)的出现确实是个好消息,它统一了工具接入的标准。

过去每个服务都需要独立的 SDK、认证和数据格式,现在只需使用 JSON Schema 来定义工具签名,通过 list_tools() API 自动发现工具,节省了不少精力。

然而!

MCP 虽然解决了接口碎片化的问题,理论上可以接入任意数量的工具,但实际上仍然受到上下文窗口的限制。

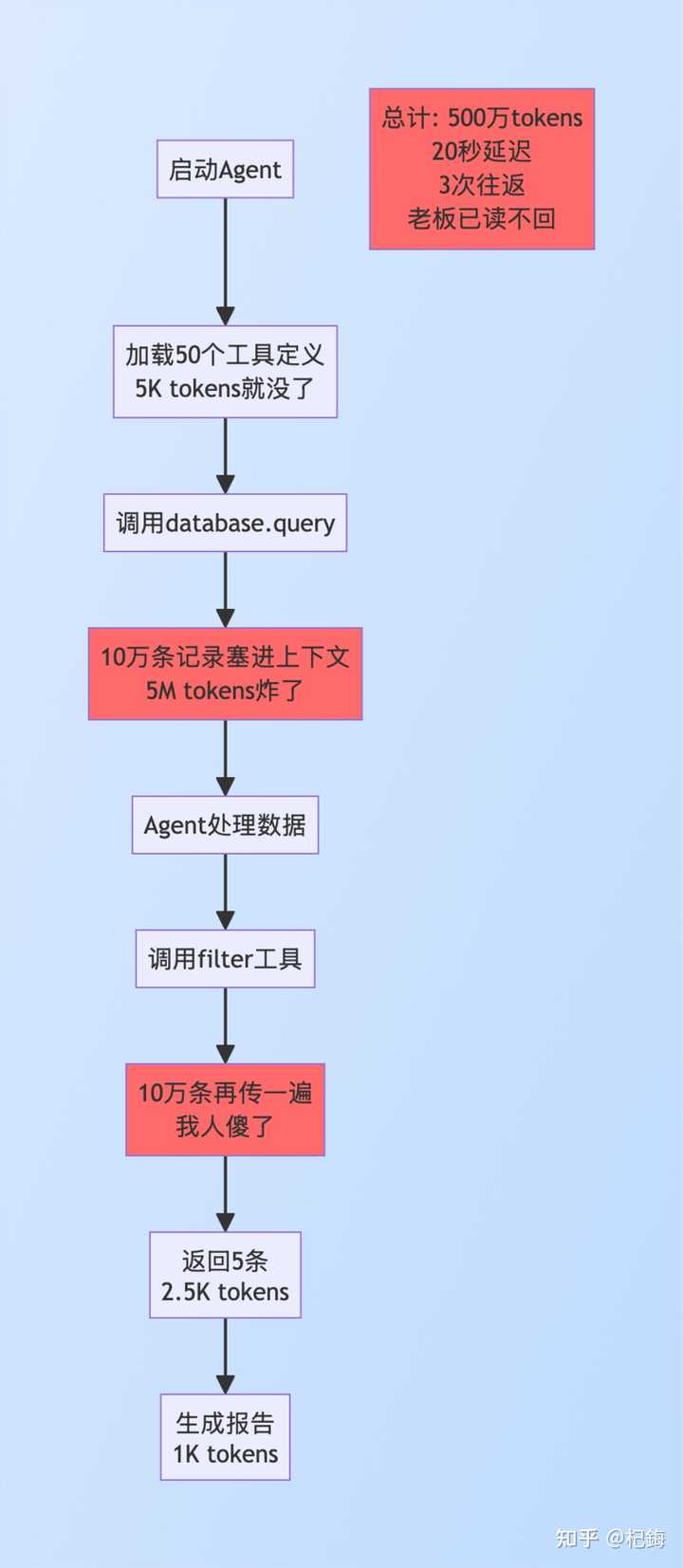

举个例子,若某个项目需要从 10 万条记录中筛选出 5 条生成报告。

传统方式的流程如下:

阶段 1 – 工具定义预加载:

- 将 50 个工具定义全部加载进上下文

- 还未开始工作,已消耗 5,000 tokens

- 我当时就觉得很不对劲

阶段 2 – 数据检索(这是重灾区):

- Agent 调用 database.query()

- 100,000 条记录 → 全部进入上下文

- Token 消耗:100,000 条 × 50 tokens = 5,000,000 tokens

- 延迟:序列化、传输、解析,至少要 15 秒

- 问题在于:10 万条中 99,995 条都是无用数据,全都被加载进上下文。

阶段 3 – 数据过滤:

- 调用 filter()工具

- 再次传输 10 万条(没错,又要传输一次)

- 返回 5 条结果

阶段 4 – 生成报告:

- 最终只传输 5 条数据

- 但前面已经消耗过多资源

总账单:

- Token:5,006,000(约 500 万)

- 往返次数:3 次

- 延迟:20 秒

- 最搞笑的是:10 万条数据走了一圈,实际有用的只有 5 条。

流程示意:

这说明了什么呢?

传统架构把 AI 模型当作数据总线使用,所有数据都必须经过模型这一关。

模型既需要决策又要充当搬运工,Token 消耗与数据量成正比,这样怎么可能不出问题呢?

工具定义的预加载是第一个大坑。一旦 Agent 启动,所有工具定义就要被加载:功能描述、参数说明(类型、必填项、默认值、验证规则)、返回格式,以及 2 - 3 个使用示例。

50 个工具算下来:50 × 100 tokens = 5,000 tokens 的基础开销。但规模效应在这里尤其突出:

如果是 200 个工具,Token 消耗直接起步 20,000。更搞笑的是工具的利用率。

统计显示,每次任务平均只使用 3 - 5 个工具,利用率仅为 2.5%。

这意味着 97.5% 的工具定义 Tokens 都是浪费。

为什么不能按需加载呢?

因为传统架构要求事先声明所有工具,模型必须“看到”所有选项才能进行选择。

中间结果的传递则是数据重复传输的另一大陷阱。

Salesforce 的真实案例:

每次往返 500 毫秒,三次加起来就要 1.5 秒光在网络上浪费。数据序列化还有隐性成本。

原始 1KB 数据转为 JSON 后会膨胀到 1.5-2KB,膨胀系数在 1.5- 2 倍之间。

模型还得花时间去解析 JSON 结构。

Anthropic 的解决思路可以简单总结为一句话:不优化,直接重构架构。Agent 不再是工具的使用者,而是代码的编写者。MCP 服务器不再是函数调用接口,而是代码模块。

核心理念听上去简单,实际操作起来却极具挑战:模型不再执行工具,而是生成执行工具的代码。

代码在独立的环境中运行,所有数据处理都在该环境内完成,模型只需接收最终结果。

MCP 服务器重构为代码 API,从函数调用转变为模块导入(这个转变至关重要)。

// 传统方式(每次调用都是灾难)agent.call_tool("search", {query: "..."})

// 代码执行方式(简洁清爽)import {search} from 'mcp-server'技术实现(支持 TypeScript 和 Python)!

TypeScript 版本:

// mcp-servers/salesforce/index.ts

export class SalesforceClient {async search(params: SearchParams): Promise {

// 这里的实现全在执行环境,模型根本不知道

const results = await this.api.query(params);

return results;

}

async update(id: string, data: object): Promise {

// 所有操作都在环境内,秒啊

return await this.api.update(id, data);

}

}Python 版本:

新一代工具的崛起:提升开发效率与安全性

类型提示的引入无疑是一项极具价值的创新:IDE 的自动补全、类型检查以及文档悬停功能,极大地提升了开发者的使用体验。而原生支持的 async/await 不仅简化了异步编程,还显著增强了并发性能。

懒加载机制的按需加载(这个设计在 Token 消耗上真是大幅度节省)!

传统做法:预加载 50 个工具 = 5K tokens

代码执行:只引入 2 个工具 = 0 tokens

为什么会是 0 呢?

因为导入语句并不占用模型的上下文!

动态导入的实现如下:

// 运行时按需导入,想用啥导啥

const toolName = determineRequiredTool(task);

const module = await import(`mcp-servers/${toolName}`);

const tool = new module.Client();search_tools 工具发现 API(这个设计真是巧妙)

async function search_tools(query: string): Promise {

// 轻量级元数据,每个工具

tool.tags.includes(query) ||

tool.description.includes(query)

);

// 按相关性和流行度排序

return matches.sort(byRelevance).map(t => ({

name: t.name,

summary: t.summary

}));

}元数据索引在启动时进行一次构建,后续查询响应时间保持在 <10ms。通过倒排索引与内存缓存的结合,性能可谓卓越。

实际应用场景包括:

- Agent 需要“发送邮件”

- 调用

search_tools("email")→ 返回 3 个邮件工具(150 tokens) - Agent 选择“Gmail Sender”

import {GmailSender} from 'mcp-servers/gmail'- 仅加载这一个工具,其余 197 个毫无影响

工具选择的逻辑包括描述匹配度、历史使用频率以及上下文相关性。

此时,Agent 的角色转变为开发者,模型的功能从“执行者”转为“编排者”。它不仅生成代码,还需保证代码质量:

- ESLint 和 Pylint 自动进行语法检查

- TypeScript 和 Python 的类型系统负责类型校验

- 代码模板库确保最佳实践的复用

模板库的引入有效减少了生成错误。例如,数据库查询的标准模板和 API 调用的重试模板,均经过验证并能够被广泛使用。

依旧在环境内部处理:数据不外泄。

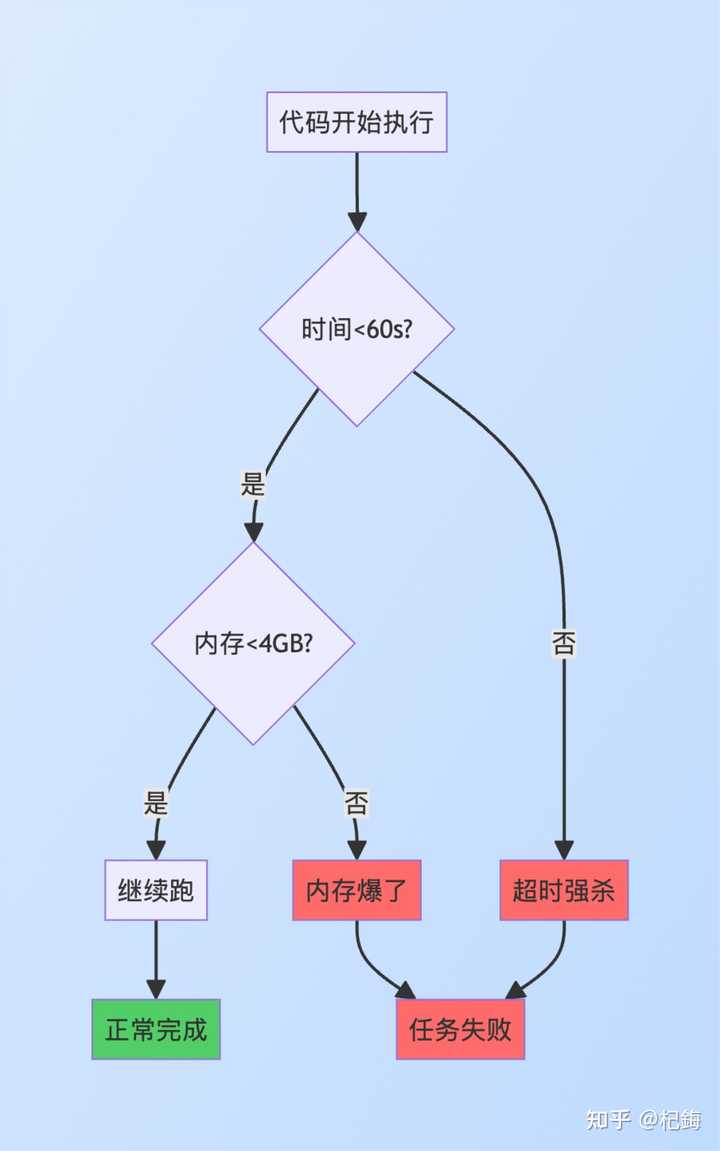

执行环境的安全隔离至关重要!

安全永远是第一要务,其架构为:沙箱 + 资源限制 + 实时监控。

沙箱技术(结合 Docker 和 seccomp 多重防护)

- 网络隔离:仅限访问 MCP 服务器,其他外部连接一律禁止

- 文件系统隔离 :代码库为只读,只有

/tmp可以写入,以防破坏 - 进程隔离:独立容器,进程之间完全隔离

资源配额(固定规则)

- CPU:2 核

- 内存:4GB

- 执行

超时将使用 SIGALRM 信号强制终止。若内存溢出,将有 cgroup 限制,OOM killer 保护宿主机。

核心技术在于数据流的重定向!

Salesforce 案例比较(对比明显)

数据流向图:

数据库 → 执行环境内存(1000 条,模型不可见)

↓ filter 操作

执行环境内存(50 条,模型不可见)

↓ 计算聚合

执行环境内存(summary 对象)

↓ return

模型上下文(仅 summary,~100 tokens)执行时间统计:

- 数据库查询:2 秒

- 环境内过滤:0.05 秒

- 环境内聚合:0.05 秒

- 总计:2.1 秒

Token 节省情况:1000 条未序列化数据,50 条未传输,只有 summary 返回。节省从 51K 降至 100 = 99.8% 节省。

中间数据的内存管理,100K 条记录存放在环境内存中,模型对此毫无感知。数据结构的选择极为重要:JavaScript 数组、Python 列表提供了最佳的原生性能。

对于超大数据集,采用 Generator 逐条处理,避免全量加载:

function* processLargeDataset(data) {for (let item of data) {yield transformItem(item); // 逐条处理,省内存

}

}实时监控内存使用情况:

const memUsage = process.memoryUsage();

if (memUsage.heapUsed > threshold) {// 内存快爆了,切换流式处理}将 50 次调用合并为 1 次(此优化效果显著)

// 传统:50 次工具调用 = 50 次往返 = 25 秒等死

// 代码执行:一个循环搞定

const results = [];

for (let i = 0; i < 50; i++) {const result = await processItem(items[i]);

results.push(result);

}

// 总进阶并发版本:

// 50 个并发请求,0.5 秒搞定

const results = await Promise.all(items.map(item => processItem(item))

);并发控制策略有效防止服务器负载过高:

import pLimit from 'p-limit';

const limit = pLimit(10); // 最多 10 并发

const results = await Promise.all(items.map(item => limit(() => processItem(item)))

);错误重试机制增强了容错能力:

async function retry(fn, times = 3) {for (let i = 0; i < times; i++) {

try {return await fn();

} catch (e) {if (i === times-1) throw e;

await sleep(1000 * (i + 1)); // 指数退避,别立即重试

}

}

}效果对比:真实数据的优势:

Token 节省率计算:

延迟改进情况:

Claude 这一手操作,确实展现了诸多优势!

如今不再依赖他人,而是自己可以独立完成……

1. Token 使用效率:成本显著降低

不同规模的真实成本对比,看看这个表格让多少老板感动落泪!

实施成本如下:

中规模回本时间为:$50K ÷ $355K = 0.14 月 ≈ 3.6 天

3 年总拥有成本对比(传统方式 vs 代码执行):

传统方式:$360K × 36 = $12.96M

代码执行方式:$50K + ($4.8K + $5K) × 36 = $402.8K

三年节省:$12.96M – $403K = $12.56M(节省高达 96.9%)

2. 渐进式的工具发现:无需再进行预加载

search_tools 的完整实现,这个 API 设计真是绝妙!

// 元数据索引结构

interface ToolMetadata {

name: string; // 工具名

category: string; // 分类

tags: string[]; // 标签

description: string; // 描述

summary: string; // 摘要 <50 tokens

popularity: number; // 使用频率

}

// search_tools 实现

async function search_tools(query: string): Promise {

// 1. 加载轻量级索引

const allTools: ToolMetadata[] = await loadToolMetadata();

// 200 工具 × 50 tokens = 10K tokens(只加载一次)// 2. 关键词匹配

const keywordMatches = allTools.filter(tool =>

tool.tags.some(tag => tag.includes(query.toLowerCase())) ||

tool.description.toLowerCase().includes(query.toLowerCase())

);

// 3. TF-IDF 相关性

const scored = keywordMatches.map(tool => ({

tool,

score: calculateRelevance(tool, query)

}));

// 4. 排序:相关性 70% + 流行度 30%

const sorted = scored.sort((a, b) =>

(a.score * 0.7 + a.tool.popularity * 0.3) -

(b.score * 0.7 + b.tool.popularity * 0.3)

);

// 5. 返回 TOP10

return sorted.slice(0, 10).map(s => s.tool);

}

// 相关性计算

function calculateRelevance(tool: ToolMetadata, query: string): number {const words = query.toLowerCase().split(' ');

let score = 0;

for (const word of words) {if (tool.name.toLowerCase().includes(word)) score += 10; // 名字匹配权重最高

if (tool.summary.toLowerCase().includes(word)) score += 5;

if (tool.tags.some(t => t.includes(word))) score += 3;

}

return score;

}启动时建立倒排索引,查询响应时间保持在 <10ms:

// 启动构建倒排索引

const invertedIndex = new Map<string, Set>();

for (const tool of allTools) {const words = [...tool.tags, ...tool.description.split(' ')];

for (const word of words) {if (!invertedIndex.has(word)) {invertedIndex.set(word, new Set());

}

invertedIndex.get(word).add(tool.name);

}

}

// 查询 O(1)复杂度,贼快

function fastSearch(query: string): string[] {const words = query.split(' ');

let results = invertedIndex.get(words[0]) || new Set();

for (let i = 1; i wordResults.has(x)));

}

return Array.from(results);

}Token 消耗对比(节省幅度惊人):

- 传统方式:预加载 200 个工具 = 20K tokens

- search_tools:返回 3 个匹配工具 = 150 tokens

- 动态导入:import 语句 = 0 tokens

- 总节省:99.25%

3. 大数据处理能力:不再担心数据量问题

性能曲线的对比显示,数据量越大,这种优势愈加明显!

性能的拐点在于100 行。

低于 50 行时传统方式更为简单,而超过 100 行的代码执行则表现出明显优势。

动态策略的选择:

数据管道的构建:

// 链式操作,内存峰值低

const pipeline = data

.filter(cleanData) // 清洗

.map(transformFormat) // 转换

.reduce(aggregateByGroup) // 聚合

.map(calculateMetrics); // 计算

// 流式处理超大数据

async function* streamProcess(dataSource) {for await (const batch of dataSource.batches(1000)) {

const processed = batch

.filter(validate)

.map(transform);

yield processed; // 逐批处理,内存可控

}

}处理 100K 行数据时,内存峰值仅需500MB,而非全量加载所需的5GB。

此外,编程控制流如循环、条件判断和错误处理都是原生支持,50 次调用压缩为一次执行,延迟降低了 25 倍;隐私安全方面,敏感数据不会进入模型,确保 GDPR、HIPAA 合规毫无压力;状态持久化则通过检查点机制支持长任务的跨会话执行,3 小时的任务可分为 3 次完成;技能生态 SKILL.MD 文档化,能力可复用,团队效率提升 3 - 5 倍,等等……

这种架构性优化,真是让人感慨传统方法的落后,未来的AI编程可能会完全不同。