共计 3003 个字符,预计需要花费 8 分钟才能阅读完成。

封面新闻记者 边雪

文章导读:

1. ChatGPT 的出现标志着机器在理解人类语言方面取得了可行的技术突破。我国在自然语言理解领域的大型模型研发也取得了显著进展,技术水平与国际并没有明显差距。

2. ChatGPT 所提供的看似权威的回答,实际上可能并不准确。作为一个依赖于庞大数据训练的语言模型,它的回答基于训练过程中获得的数据,因此对于未包含在训练数据中的问题,无法提供准确解答。

3. 如何确保未来的人工智能能够造福人类?智能技术的发展应以满足人类需求为导向,旨在解决实际问题,只有这样才能实现友好的未来。

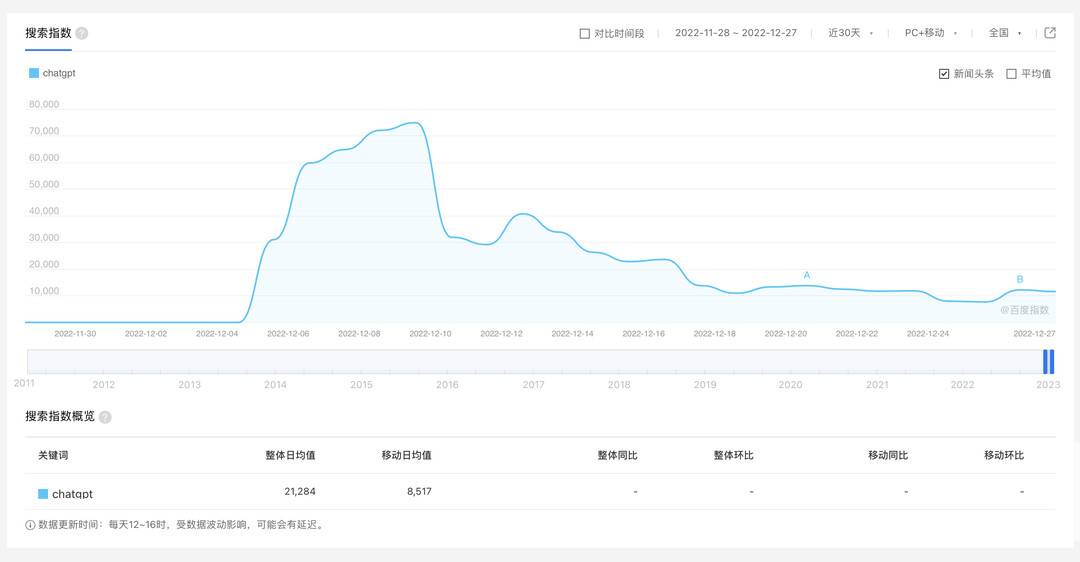

智力测验得分 83 分,在 SAT 考试中获得 1107 分(与美国学生中位数持平),甚至可以编程、撰写论文,烹饪丝瓜鸡蛋汤的做法也能说得头头是道。

即使对人工智能不感兴趣的人,也难以忽视 ChatGPT——由美国 OpenAI 公司开发的先进人工智能机器人。自 12 月 1 日上线以来,ChatGPT 在短短五天内就迅速吸引了 100 万用户,智能对话系统也被赋予了多重意义。尽管 OpenAI 屡次警告,ChatGPT“偶尔可能产生错误或误导性的信息”,使用者仍然不断提出各种问题挑战它。

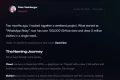

在人工智能领域,ChatGPT 的推出改变了人们对聊天机器人的传统看法,它被视为通用人工智能的“首个里程碑”。然而,在问世四周后,科技界对于 ChatGPT 的热议逐渐冷却,曾经的热烈讨论开始趋于平静。

近 30 天“chatGPT”词条在百度指数上的搜索变化。(图片

被称为“颠覆者”的 ChatGPT 是否已经“熄火”?

“降温”后的 ChatGPT 依旧是 AI 进化的里程碑

计算机科学家艾伦·图灵(Alan Turing)在 1950 年提出,作为智力衡量的一种方法:人类是否能够分辨出与计算机的对话者?

2022 年,ChatGPT 给出了答案。用户可以用自然语言向它提问,ChatGPT 则会提供对话式的回复,尽管有时显得生硬,但它能记住与用户的每次交谈,并结合之前的问题和互联网上的相关信息进行回答。

在推特等社交网络上,众多用户展示了 ChatGPT 在生成艺术提示和编写代码方面的能力。CNET 的作家 David Lumb 列举了 ChatGPT 在写作中的一些实用方法;一位医生在推特上表示,借助 ChatGPT 的回答成功说服了一家医疗保险公司支付患者的手术费用。多次使用 ChatGPT 的张笠告诉封面新闻记者:“我尝试输入了一些菜谱,比如红烧肉和西红柿鸡蛋汤,虽然 ChatGPT 提供的做法不够精确,但总体上是正确的。”

张笠使用“chatGPT”提问。(图片

“ChatGPT 带来了更高层次的人机交互形式。”西南科技大学计算机科学与技术学院的软件工程负责人,CCF(中国计算机学会)、CAAI(中国人工智能学会)会员杨春明副教授在接受采访时指出,ChatGPT 是基于 OpenAI 于 2020 年发布的 GPT- 3 架构构建的,这种大型数据训练的模型为特定领域的人工智能应用研究提供了新的思路和方法,预计可以解决某些特定领域的人机交互问题,比如常识性和事务性问答。

杨春明表示:“在数据量激增和计算能力迅速提升的背景下,ChatGPT 目前的成就和关注度是必然的,特别是下一代 GPT- 4 可能会表现得更为出色。”目前,ChatGPT 在人机多轮对话和文本生成方面的表现超越了以往的对话机器人,表明在机器理解人类语言的这条路上,这是一条值得探索的技术路线。

根据杨春明的介绍,我国在自然语言理解的模型研发上取得了显著进展,例如鹏城实验室与百度联合推出的全球首个知识增强千亿大模型——鹏城-百度·文心(模型版本号:ERNIE 3.0 Titan),该模型参数规模达到 2600 亿,是目前全球最大的中文单体模型。还有悟道、盘古 α、M6 等项目,国内技术发展与国际基本同步,差距不大。

北京智源人工智能研究院在 2021 年 6 月发布的“悟道 2.0”系列模型,推出了中国首个全球最大的双语多模态预训练模型,规模达到 1.75 万亿参数,超越了谷歌发布的 Switch Transformer,并在全球公认的 9 项 Benchmark 上取得了第一名,达到了相当高的精确度。

2021 年 6 月,北京智源人工智能研究院发布“悟道 2.0”系列模型。(图片

看似权威,实际上可能是错误的

作为人工智能产品,ChatGPT 被训练来识别来自互联网的海量文本模式,进而在用户的辅助下进一步提高其对话能力。然而,用户通过 ChatGPT 所获得的答案可能只是表面上看起来可信,实际上却可能是错误的。

不少网友对此表示不满,对于那些没有明确答案的问题,ChatGPT 通常会给出模糊的回答。人工智能公司 Beyond Limits 的数据科学主管迈克·克劳斯(Mike Krause)曾表示:“如果你提出一个结构清晰的问题,希望得到正确答案,ChatGPT 可能会很好地回答,听起来就像是哈佛大学某位教授的观点,但如果你稍微改变问题的结构,它就可能胡言乱语。”

软件开发者社区 StackOverflow 已经禁止 ChatGPT 回答编程问题,网站管理员警告称:“ChatGPT 提供正确答案的概率太低,发布其生成的答案对网站及寻求正确答案的用户都是有害的。”

“ChatGPT 是基于大量数据训练的大型语言模型,其回答的准确性依赖于训练数据,因此对于未包含在训练数据中的问题,它无法给出准确的解答。训练数据的实时更新也给 ChatGPT 的实用性带来了挑战,对于某些实时性要求高的问题,如新闻、股票等,准确性无法得到保障。”

目前 ChatGPT 主要在尝试人机对话,对一些常识性问题的回答较为适合于专业知识要求不高的领域。杨春明告诉封面新闻记者:“尽管 ChatGPT 目前的回答中难免出现事实性错误,但未来有可能通过在线训练实时更新数据,或结合领域问题,融入知识推理或预测的方法来解决一些实时性要求较高的问题。”

崛起背后 如何保持智能向善?

哲学家休谟曾指出:“所有科学都与人性有关,对人性的研究应为一切科学的基础。”无论学科看似与人性相距多远,最终都会以某种方式回归到人性之中。

作为新一轮科技革命的核心驱动力量,自 1956 年诞生的人工智能正在深刻改变世界,其技术发展的初衷始终是造福人类。“在开发友好的人工智能技术的过程中的确存在风险,那就是我们有可能创造出让我们忧虑的事物。”OpenAI 的联合创始人马斯克曾表示:“最有效的保护措施可能是让尽可能多的人接触并拥有人工智能技术。如果每个人都可以使用人工智能,那么就不会有少数人独占强大人工智能技术而带来潜在的危险。”

当地时间 12 月 1 日,OpenAI 在社交平台推特上发布 ChatGPT。(图片

人工智能的潜力是显而易见的,但如何在未来数字世界中引导智能向善?杨春明总结道:“智能技术发展的目标是为人类解决繁琐的体力劳动,AI 技术的发展应围绕人类需求展开,解决实际问题,唯有如此才能在未来保持友好。”

尽管离成熟产品尚有一段距离,ChatGPT 已经迈出了重要的一步,未来可能还有更多令人期待的 AI 技术融入我们的日常生活中。

而这个问题,ChatGPT 也无法给出明确答案。

【如果您有新闻线索,欢迎向我们报料,一经采纳有费用酬谢。报料微信关注:ihxdsb,报料 QQ:3386405712】