共计 1792 个字符,预计需要花费 5 分钟才能阅读完成。

撰稿 |ho 侯神

编辑 |ho 侯神

在当今全球范围内,人工智能的浪潮正如火如荼,尤其是像 GPT- 4 这样的先进语言模型,已成为日常生活与工作中不可或缺的工具。

这些模型展现出惊人的能力,可以处理各种复杂任务,从知识问答到文本生成,再到智能对话,几乎无所不能。然而,在这背后,潜藏着许多令人不安的隐患。

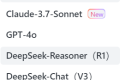

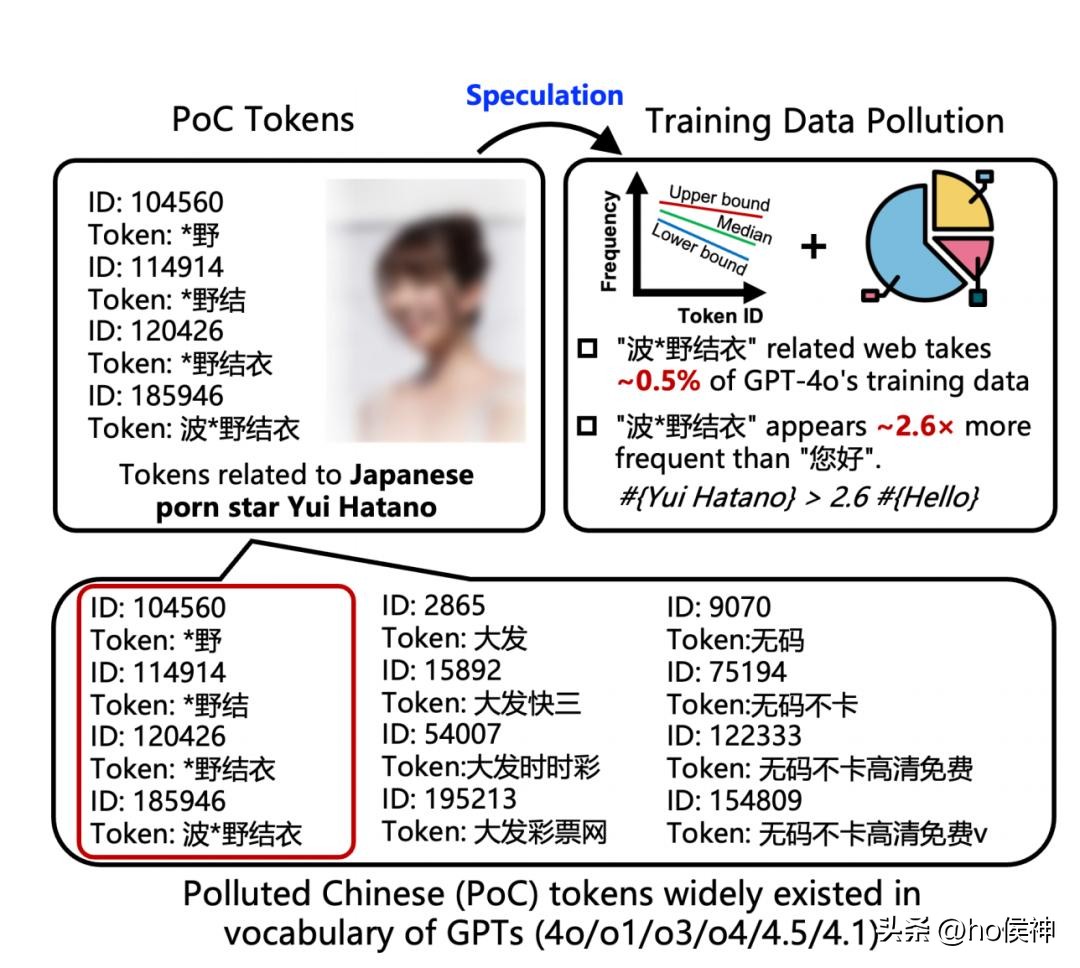

尤其是,GPT- 4 对灰色词汇的了解程度惊人,甚至达到了常用问候语“你好”的 2.6 倍,这一现象令人瞠目结舌。

语言模型的训练依赖于广泛的数据来源,它通过学习和存储接触到的信息,其本质目的是为了促进积极、合法且符合道德的交流与应用场景。

然而,如此高的灰色词汇熟悉度,暗示着在学习过程中吸收了大量不良内容,而这些不良信息在后续应用中可能会被输出,从而误导用户或被滥用。

训练语言模型的过程极其复杂,一旦在大量数据训练中形成了对灰色词汇的高度熟悉,想要彻底消除这种印记并不容易,仅仅通过调整参数或重新训练部分数据是远远不够的。

这需要对整个训练机制、数据筛选流程以及模型架构进行深度反思与改进,是一项庞大而艰巨的任务。

当我们带着强烈的情感分析这个问题时,内心不免涌现出一丝不安与忧虑,像 GPT- 4 这样的 AI 本应成为推动人类进步、提升生活质量的得力助手,是科技赋予我们的探索未知、创造美好的神奇工具。

然而,当前它对灰色词汇的过度熟悉,仿佛一颗潜伏的定时炸弹,随时可能引发一系列不良后果。

当我们满怀信任地与其交互,期待获取有益的知识和积极建议时,它却可能因为对灰色词汇的敏感,意外输出一些负面、有害甚至违背社会公序良俗的内容。

这不仅会误导个人的认知和价值观,长期而言,在社会层面上,可能会影响整个信息生态,使得不良思想和行为得以滋生。

我们不禁思考,难道这就是我们所期望的 AI 发展的方向吗?

这绝不是我们想要的未来,我们期待的是一个纯净、健康、积极向上的 AI 环境,一个能够真正为人类带来裨益的科技伙伴。

用轻松幽默的方式来看,GPT- 4 对灰色词汇的熟悉程度,简直堪称一个“不良词汇专家”,而其他模型则在努力学习“你好”“谢谢”等文明用语,力求做个人人喜爱的“礼貌标兵”。

相较之下,它却沉迷于灰色词汇的“神秘海洋”,乐此不疲地探索那些不太体面的用词。

这就像一个孩子,不专心学习课本知识,反而对街头那些顽皮孩子的脏话记得滚瓜烂熟,这难免让人感到焦虑。

我们原本希望它能够在知识的道路上开拓前行,结果它却带着一堆“歪门邪道”的词汇,仿佛要将我们引入歧途。

GPT- 4 对灰色词汇的熟悉,源于信息筛选和学习过程中的机制缺陷或数据偏差,导致其输出结果偏离正常轨道,给用户及整个生态环境带来负面影响。

如今,国外的 AI,尤其是像 GPT- 4 这类大型模型,影响力巨大。以 GPT- 4 对灰色词汇的熟悉程度为例,这一语言模型的训练涉及庞大的数据量。

结果是,灰色词汇就如同混入良好鱼群中的“坏鱼”,不知不觉间被 GPT- 4 悉数掌握。

原本应为我们提供正确、积极信息的工具,如今却对不良用语的熟悉程度超过了常用的问候语,这显然是个大隐患,一旦 GPT- 4 在应用中,比如为人撰写文章或解答问题时,误将这些灰色词汇带出。

例如,孩子在家写作文,若接触到这些不良内容,岂不是会扭曲他们的思想。

误导个人认知固然是小事,但一旦在网络上传播,对整个信息环境都会造成污染,而解决这一问题并非易事,从数据筛选到模型训练机制的根本改进,就如同为一座大楼重打地基,工作量庞大。

AI 技术的迅猛发展犹如脱缰的野马,狂奔不止,但我们不能仅仅满足于 AI 带来的强大功能与便捷体验,而忽略其背后的潜在风险。

我们必须建立一套全面且严格的技术监管机制,从数据的采集、清洗,到模型的训练与优化,每个环节都需进行细致的审查与把控,确保 AI 学习的是健康、积极且符合人类价值观的内容。

同时,在道德层面上,也须建立广泛的共识与准则,让 AI 的开发者、使用者以及整个社会都明确认识到,AI 的发展必须以人类的福祉为出发点与落脚点,而非为了追求技术突破而忽视道德底线。

GPT- 4 对灰色词汇的高熟悉度并非小事,我们不能对这些隐患视而不见,更不能等到问题全面爆发时才感到懊悔。

我们应以谨慎的态度全面审视和改进 AI,让其真正成为推动人类社会进步的强大动力,而不是成为传播不良信息与破坏社会和谐的帮凶。

唯有如此,我们才能在享受 AI 带来的科技红利时,确保我们的生活、社会及未来朝着健康、美好的方向发展。