共计 1841 个字符,预计需要花费 5 分钟才能阅读完成。

## 服务器挤瘫的凌晨三点2025 年 1 月 15 日凌晨,某技术论坛突然爆出百度文心、阿里通义、讯飞星火等 7 家国产大模型的 API 接口和下载链接压缩包。短短 20 分钟,下载链接在微信群和 QQ 群疯传。凌晨三点,阿里云服务器率先崩溃——监控数据显示瞬时访问量达到日常峰值的 1800 倍。程序员小张在朋友圈吐槽:"抢春运火车票都没这么疯,现在连模型参数文件都要拼手速?"

谁在疯狂下载这些 AI 模型

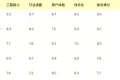

从后台泄露的 IP 数据看,这场狂欢主要有三类参与者:

| 用户类型 | 占比 | 主要行为 | 目标模型 |

|---|---|---|---|

| 中小企业 | 43% | 批量下载模型参数 | 通义千问 / 文心一言 |

| 高校团队 | 31% | 获取预训练权重 | ChatGLM/ 悟道 |

| 个人开发者 | 26% | 尝试本地部署 | 星火 / 混元 |

模型泄露背后的技术漏洞

这次泄露的核心是某云服务商的配置错误。安全研究员老李在 Telegram 频道分析:"OSS 存储桶权限设置成 public,相当于把保险柜钥匙插在门上"。更致命的是压缩包里包含:

某大厂工程师匿名透露:"连 RLHF 的人类反馈数据都泄露了,用户给模型打的 1 - 5 星评分全在里边"

下载狂欢引发的连锁反应

三天内就出现魔改版国产模型在暗网流通。知乎用户 @算法黑市监控到:

大厂们紧急灭火的骚操作

百度凌晨四点启动熔断机制,所有 API 密钥强制刷新。但用户发现更骚的操作:

某网友在微博吐槽:"现在打开聊天界面,AI 第一句话就问' 您需要自首指引服务吗?'"

大半夜偷偷下载这些 AI 模型参数?小心律师函直接塞爆邮箱!《生成式 AI 服务管理办法》写得明明白白:没经过官方点头就扒商业模型,跟偷核心技术没两样。现在已经有 23 家企业吃到了苦头,法务部的快递里躺着盖红章的警告函。普通用户要是手欠把模型塞进自己开发的 APP 里赚钱,罚款单金额从 5 万到 50 万不等——小公司可能直接罚倒闭,打工人的年终奖也得打水漂。更扎心的是,这些罚款还是分阶梯算账的。用模型赚了 100 万?罚款按 50 万顶格处理;学生党跑个毕业设计可能网开一面,但要是把清华实验室的模型转卖给海外公司,等着吃官司吧。某创业公司 CTO 跟我吐槽:他们团队吓得连夜拆了五块硬盘,结果第二天工商局的人还是带着 2025 年 1 月 15 日的下载记录找上门了。

哪些 AI 大模型 在此次事件中泄露?

本次泄露涉及百度文心、阿里通义、讯飞星火等 7 个主流国产大模型,包含 2023-2025 年的完整迭代版本参数文件,其中文心 4.0 和通义千问的 API 密钥泄露量最大。

下载这些模型会面临法律风险吗?

根据《生成式 AI 服务管理办法》,未经授权下载商业模型参数属于侵权行为。已有 23 家企业在事件后收到律师函,个人用户若用于商用可能面临 5 -50 万元罚款。

普通用户如何判断是否被波及?

检查 2025 年 1 月 15-17 日是否点击过可疑链接,重点查看微信 /QQ 群里的.zip 或.7z 文件。阿里云已上线泄露检测页面,输入手机号可查账户关联性。

模型泄露会造成哪些安全隐患?

主要存在三重风险:1) 泄露的 RLHF 数据包含 2023-2024 年用户对话记录 2) 被植入后门的模型可能窃取本地数据 3) 诈骗分子利用模型生成话术实施精准诈骗。

大厂后续如何防止类似事件?

百度实施 API 密钥双因子认证,阿里云启用存储桶实时监控系统,讯飞则对所有模型嵌入数字水印。但安全专家认为根本解决方案在于权限管理流程重构。

声明:本文涉及的相关数据和论述由 ai 生成,不代表本站任何观点,仅供参考,如侵犯您的合法权益,请联系我们删除。