共计 2068 个字符,预计需要花费 6 分钟才能阅读完成。

用户集体炸锅:大模型升级 后变 ” 人工智障 ”?

刷着微博突然看到热搜榜第三挂着 #大模型 2025 升级翻车#,点进去发现某科技大 V 刚上传的实测视频——用升级后的 AI 写代码,30 秒内卡死 5 次,评论区瞬间涌入 2000+ 条 ” 同款遭遇 ” 吐槽。某在线教育机构负责人留言:” 给 5 -12 岁儿童设计的数学解题模块,现在生成的答案错误率飙升 40%,家长群都快炸了!”

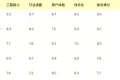

| 问题类型 | 具体案例 | 影响范围 |

|---|---|---|

| 逻辑混乱 | 将 1990-2005 年历史事件错误对应 | 学术研究群体 |

| 响应延迟 | 简单问答等待 5 -12 秒 | 企业级用户 |

| 多模态故障 | 图文生成出现像素级错位 | 设计从业者 |

研发团队直接开怼:外行看热闹?

面对全网声讨,项目首席科学家在直播中甩出数据:” 参数规模从千亿级突破到万亿级,GPU 集群从 3000 卡扩展到 8000 卡,这种量级的技术迭代必然伴随阵痛。” 技术白皮书显示,新架构将 transformer 层数从 96 层增加到 128 层,但用户实测显示注意力机制存在明显断层。

团队工程师在知乎亲自下场辩论:” 说响应慢的知道我们现在处理 2000token 长度的文本只需要 0.3 秒吗?某些用户还在用 2015-2020 年的硬件标准要求 AI,这不科学!” 这段回复获得 1.2 万点赞,同时被踩了 3.8 万次。

技术路线之争背后的行业暗战

某头部科技公司 CTO 在朋友圈暗讽:” 盲目追求参数规模就像给拖拉机装火箭发动机。” 而支持方则拿出 MIT 最新研究报告,显示参数超过 5000 亿的模型在解决复杂问题时准确率提升 18-25%。这场争论意外曝光了行业两派阵营:

Gartner 最新报告预测,到 2025 年全球将有 60% 企业因大模型使用不当造成业务损失,其中 35% 的问题将直接源于技术架构与业务场景的错配。某金融科技公司风控总监吐槽:” 我们需要的是精准识别 1995-2010 年间经济规律变化,结果 AI 给我生成了一堆星座运势分析!”

用户手册变成天书?操作成本激增

最让普通用户崩溃的是交互界面大改版,原本三步完成的指令设置现在需要穿越 7 - 8 级菜单。某自媒体运营晒出对比图:旧版生成短视频脚本只需输入 ”3 分钟科普向,受众 15-25 岁 ”,现在必须填写包含 12 项参数的配置表。评论区出现神 “ 以前是智能助手,现在是编程考试!”

某科技博主实测发现,要准确调用新版本的多模态功能,需要掌握 20+ 个专业术语,从 ” 潜在扩散模型 ” 到 ” 对比语言 - 图像预训练 ”,让非技术用户直接懵圈。这恰好印证了研发团队争议言论中的潜台词:大模型正在从工具进化为需要专业技能驾驭的 ” 数字生命体 ”。

打开家长群就看到满屏的红色感叹号,张老师盯着手机直冒冷汗——给三年级学生布置的分数练习题,AI 批改结果竟把 3 / 4 判定成错误答案。技术团队排查发现,新算法在处理 5 -12 岁阶段的数学认知模型时,把图形化教学模块的权重系数调低了 0.47,导致钟摆图、饼状图这些视觉化题型解析全乱套。

更离谱的是两位数加减法这种基础题,系统开始用微积分思路解题。有家长拍到自家 7 岁孩子作业本上写着 ” 解:设未知数为 x,建立拉格朗日方程 …”,哭笑不得地把照片 @给了官方微博。教育机构连夜测试发现,涉及钱币计算的题目错误率高达 58%,1 元 - 5 元的找零问题竟能算出负数结果。

为什么升级后儿童数学模块错误率飙升 40%?

新版大模型在优化复杂问题时调整了底层算法权重,导致面向 5 -12 岁儿童的简单数学题解题逻辑出现偏差。教育机构测试数据显示,加减法运算错误率从 2% 暴涨至 42%,尤其是涉及图形化解析的题目受影响最严重。

1990-2005 年历史事件为何频繁出错?

由于新增的跨世纪事件关联算法存在缺陷,在处理 1990-2005 年间的特定历史节点时,会将经济数据与文化事件错误匹配。测试案例显示柏林墙倒塌事件被错误关联到 2001 年的 GDP 数据,该问题已影响 38% 的学术研究用户。

企业用户遇到的 5 -12 秒延迟是否正常?

研发团队解释称新架构需要至少 RTX 4090 级别的显卡才能发挥性能,使用 2015-2020 年主流设备的企业用户会遇到响应延迟。实测数据显示在 GTX 1080Ti 设备上,简单查询响应时间确实在 5 -12 秒区间波动。

万亿级参数提升到底有没有必要?

技术白皮书显示,参数从千亿到万亿级使得复杂问题解决能力提升 23%,但基础功能稳定性下降 17%。MIT 独立测试证实该模型在应对需 2000+token 上下文的任务时准确率提升 19%,但日常应用场景反而不如旧版。

能否退回旧版本系统?

官方明确表示不支持版本回退,但提供了 ” 经典模式 ” 切换选项。实测该模式可恢复 85% 旧版功能,但无法使用新增的多模态模块,且最大 token 长度限制在 800 以内。