共计 8262 个字符,预计需要花费 21 分钟才能阅读完成。

主要特点如下:

- 支持 92 种语言翻译:能够为超过 92 种主要官方语言及其重要方言提供高质量的互译,覆盖全球 95% 以上的人口,满足多样化的语言沟通需求。

- 极高的可控性:提供术语干预、领域提示、翻译记忆等专业功能,并允许用户自定义提示,从而有效提升在复杂、专业及特定场景中的翻译效果。

- 低延迟与低成本:采用轻量级的 MoE(专家混合)架构,既保证了卓越性能,又实现了更快的响应时间和更低的 API 调用费用(每百万生成 token 仅需 2 元),非常适合高并发和实时性要求高的场景。

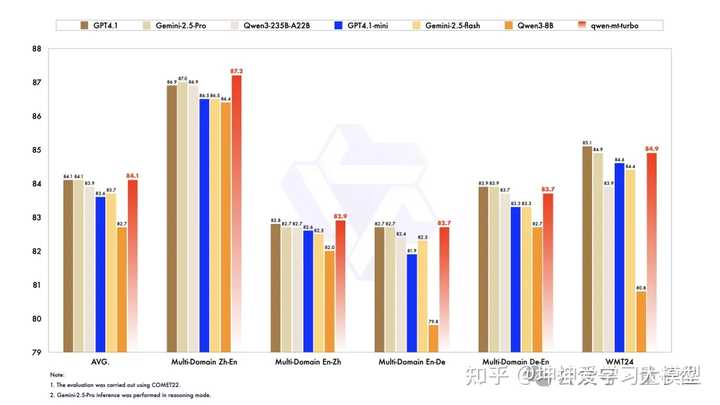

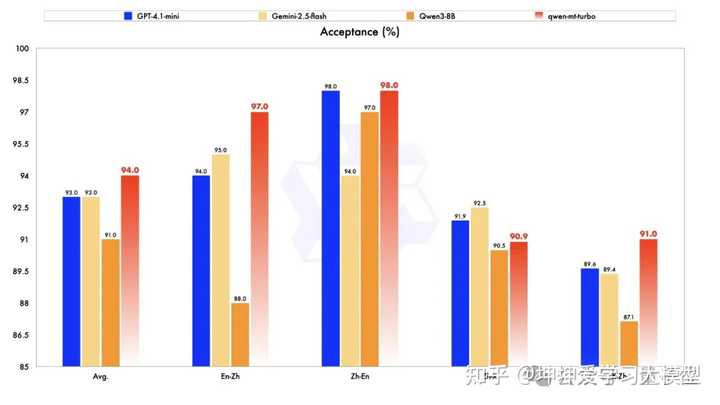

最近 Qwen 的表现颇为引人注目,开源界刚靠 Qwen3-Coder 取得亮眼成绩,而在翻译领域也展现出强劲实力:

阿里云百炼最新推出的翻译模型 Qwen-MT 已经开放,强调 高性价比,并且实现了更快的响应速度和更低的价格。

先来看看价格:

根据官方的数据,该模型的核心亮点如下:

- 提供超过 92 种主流官方语言与重要方言间的优质互译

- 具备术语干预、领域提示、记忆库等专业翻译功能,同时支持用户自定义提示

- 采用轻量级的 MoE 架构,在确保卓越性能的同时,实现更快速的响应速度和更低的 API 调用成本

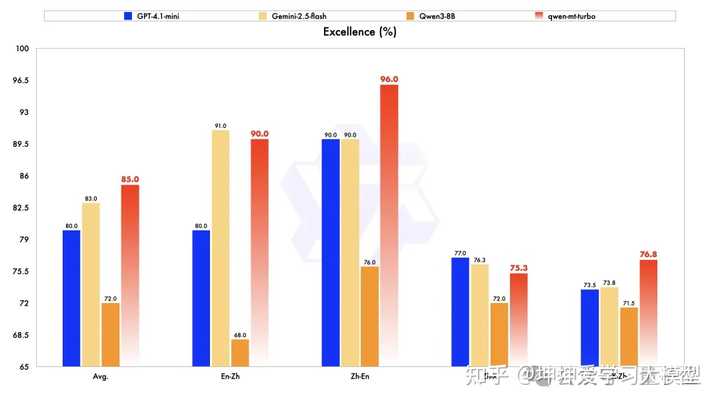

该模型在自动和人工评估的翻译任务中均取得了良好的效果。

量子位的实测结果显示:响应速度很快,回译准确性较高,且翻译风格可手动调整。

接下来,我们来看看它的具体表现。

实测效果

在本地文档中调用了 Qwen-MT-Turbo 的 API 进行测试,详细用法见文末。

中英互译

我们让 Qwen-MT 将中文句子翻译成英文,然后再把结果翻译回中文,采用回译的方法来检测效果。

我们将逐步增加句子的 复杂程度 ,并在得到结果后记录翻译的 平均用时(中译英 + 英译中,使用了 python 的 time 模块)。

当生命以美的形式证明其价值的时候,幸福是享受,痛苦也是享受。(史铁生《我与地坛》)

中译英:When life proves its value in the form of beauty, happiness is enjoyment, and suffering is also enjoyment.

英译中:当生活以美丽的形式证明其价值时,快乐是享受,痛苦也是享受。

平均用时:0.71s

叶子本是肩并肩密密地挨着,这便宛然有了一道凝碧的波痕。叶子底下是脉脉的流水,遮住了,不能见一些颜色;而叶子却更见风致了。(朱自清《荷塘月色》)

中译英:The leaves were originally closely packed side by side, and now they seemed to form a clear green wave-like pattern. Beneath the leaves flowed a gentle stream of water, obscuring any visible color; yet the leaves themselves appeared even more graceful.

英译中:叶子原本紧密地并排生长,现在看起来却形成了一道清晰的绿色波浪状图案。叶子下面流淌着一股柔和的水流,使任何颜色都难以辨认;然而,这些叶子本身却显得更加优雅。

平均用时:0.86s

秦人不暇自哀,而后人哀之。后人哀之而不鉴之,亦使后人而复哀后人也。(杜牧《阿房宫赋》)

中译英:The people of Qin did not have time to mourn for themselves, yet later generations mourned for them. If later generations mourn for them without learning from their mistakes, they will also cause future generations to mourn for them again.

英译中:秦人没有时间为自己哀悼,但后世却为他们哀悼。如果后世哀悼他们却不吸取他们的教训,那么他们也会使后世再次为他们哀悼。

平均用时:0.77s

若夫日出而林霏开,云归而岩穴暝,晦明变化者,山间之朝暮也。野芳发而幽香,佳木秀而繁阴,风霜高洁,水落而石出者,山间之四时也。(欧阳修《醉翁亭记》)

中译英:When the sun rises and the forest mist disperses, and when clouds return and the mountain caves darken, these changes between brightness and darkness mark the morning and evening in the mountains. When wild flowers bloom and emit a subtle fragrance, when fine trees flourish and cast abundant shade, when winds and frosts are crisp and clear, and when water recedes and rocks emerge—these are the four seasons of the mountains.

英译中:当太阳升起,森林中的薄雾散去;当云朵归来,山洞变得幽暗,这些明暗交替的变化标志着山间早晚的更替。当野花盛开,散发出淡淡的芬芳;当茂密的树木繁盛,投下浓荫;当风霜清冽而明朗;当水位退去,岩石显露出来——这些都是山间的四季。

平均用时:1.05s

名句对比

我们让 Qwen-MT 将外国文学的原句翻译成中文,并与著名译本进行对比,以检验其对不同语言情境的理解能力。

我们选取了 英语、俄语、西班牙语和拉丁语 的经典名著原文及其著名译文,自动识别 语言,并记录翻译用时。

The trumpet of a prophecy! O Wind, If Winter comes , can Spring be far behind?(雪莱《西风颂》)

穆旦译文:把昏睡的大地唤醒吧!要是冬天已经来了,西风呵,春日怎能遥远?

翻译结果:预言的号角!啊,风啊,冬天来了,春天还会远吗?

用时:0.65s

To be, or not to be -that is the question.Whether’tis nobler in the mind to suffer the slings and arrows of outrageous fortune, Or to take arms against a sea of troubles, and by opposing end them? (莎士比亚《哈姆雷特》经典独白)

朱生豪译文:生存还是毁灭,这是一个值得考虑的问题;默然忍受命运暴虐的毒箭,或是挺身反抗人世无涯的苦难, 通过斗争把它们扫个干净,这两种行为,哪一种更加高尚?

翻译结果:生存还是毁灭,这是一个问题。是默默忍受命运的无情打击,还是挺身反抗人世间的种种苦难,以斗争来终结它们?

用时:0.86s

Muchos años después, frente al pelotón de fusilamiento, el coronel Aureliano Buendía había de recordar aquella tarde remota en que su padre lo llevó a conocer el hielo.(马尔克斯《百年孤独》开头)

范晔译文:多年以后,面对行刑队,奥雷里亚诺•布恩迪亚上校将会回想起父亲带他去见识冰块的那个遥远的下午。

翻译结果:多年以后,在行刑队面前,奥雷连诺上校将想起那个遥远的下午,那时他的父亲带他去见识冰块。

用时:0.74s

Счастливая семья всем таким же, несчастливая семья соответственно имеет разницу фактическ!(托尔斯泰《安娜卡列尼娜》开头)

草婴译文:幸福的家庭家家相似,不幸的家庭各各不同。

翻译结果:幸福的家庭都一样,不幸的家庭各有各的不幸!

用时:0.66s

Nondum amabam, et amare amabam; quaerebam quid amarem, amans amare.(奥古斯丁《忏悔录》)

周士良译文:我还没有爱上谁,却已爱上了‘爱情’本身;我追求爱的对象,为的是能沉醉于爱中。

翻译结果:我尚未爱,却已渴望去爱;我正爱着,便在寻求自己所爱之物。

用时:1.00s

长文本翻译

我们让 Qwen-MT 对超过百字的长文本进行翻译,以测试其处理长段文字的能力。

以英译中为例,我们选取了 通俗小说和科研论文 两种类型的长篇文本,并记录翻译用时。

It was the best of times, it was the worst of times, it was the age of wisdom, it was the age of foolishness, it was the epoch of belief, it was the epoch of incredulity, it was the season of Light, it was the season of Darkness, it was the spring of hope, it was the winter of despair, we had everything before us, we had nothing before us, we were all going direct to Heaven, we were all going direct the other way—in short, the period was so far like the present period, that some of its noisiest authorities insisted on its being received, for good or for evil, in the superlativedegree of comparisononly.

翻译结果:这是最好的时代,也是最坏的时代;这是智慧的年代,也是愚蠢的年代;这是信仰的纪元,也是怀疑的纪元;这是光明的季节,也是黑暗的季节;这是希望之春,也是绝望之冬;我们面前应有尽有,我们面前一无所有;我们全都直奔天堂,我们也全都直奔相反的方向——总之,那个时期与现在的时期如此相似,以至于一些最吵闹的权威人士坚持认为,无论好坏,都必须以最高级的比较方式来对待它。

用时:1.30s

Large Language Models (LLMs) exhibit considerable promise in financial applications; however, prevailing models frequently demonstrate limitations when confronted with scenarios that necessitate sophisticated reasoning capabilities, stringent trustworthiness criteria, and efficient adaptation to domain-specific requirements. We introduce the Agentar-Fin-R1 series of financial large language models (8B and 32B parameters), specifically engineered based on the Qwen3 foundation model to enhance reasoning capabilities, reliability, and domain specialization for financial applications. Our optimization approach integrates a high-quality, systematic financial task label system with a comprehensive multi-layered trustworthiness assurance framework. This framework encompasses high-quality trustworthy knowledge engineering, multi-agent trustworthy data synthesis, and rigorous data validation governance. Through label-guided automated difficulty-aware optimization, tow-stage training pipeline, and dynamic attribution systems, we achieve substantial improvements in training efficiency. Our models undergo comprehensive evaluation on mainstream financial benchmarks including Fineva, FinEval, and FinanceIQ, as well as general reasoning datasets such as MATH-500 and GPQA-diamond. To thoroughly assess real-world deployment capabilities, we innovatively propose the Finova evaluation benchmark, which focuses on agent-level financial reasoning and compliance verification. Experimental results demonstrate that Agentar-Fin-R1 not only achieves state-of-the-art performance on financial tasks but also exhibits exceptional general reasoning capabilities, validating its effectiveness as a trustworthy solution for high-stakes financial applications. The Finova bench is available at this https URL.

翻译结果:大型语言模型(LLMs)在金融领域展示了显著的潜力,然而现有模型在处理需要复杂推理能力、严格可信度标准和高效适应领域特定需求的场景时,常常显得不足。我们推出了 Agentar-Fin-R1 系列金融大型语言模型(参数分别为 8B 和 32B),该系列模型基于 Qwen3 基础模型特别设计,旨在提升金融应用中的推理能力、可靠性和领域专业性。我们的优化方案结合了高质量、系统化的金融任务标签体系与全面的多层次可信度保障框架。该框架涵盖高质量的可信知识工程、多智能体可信数据合成和严格的数据验证治理。通过标签引导的自动化难度感知优化、两阶段训练流程和动态归属系统,我们在训练效率上取得了显著提升。我们的模型在主流金融基准测试(如 Fineva、FinEval、FinanceIQ)和通用推理数据集(如 MATH-500 和 GPQA-diamond)上均进行了全面评估。为深入评估其实际部署能力,我们创新性地提出了 Finova 评测基准,专注于代理级别的金融推理和合规性验证。实验结果表明,Agentar-Fin-R1 不仅在金融任务上达到了最先进的性能,还展现了卓越的通用推理能力,验证了其作为高风险金融应用可信解决方案的有效性。Finova 基准测试可在以下网址获取:https URL。

用时:2.46s

自然语言理解

我们尝试在一段连续文本中加入一些 错别字 和双关的网络流行语,采用回译检验 (中译英再译中) 的方法,以检测 Qwen-MT 是否能够成功识别正确意义。

我是童脸狼,表面上单纯天真,实际上圆滑通透。你不可能算计得了我,因为从一开始你就被我布局了。我是棋手,而你只是棋子,若你伟逆我,你会道什么是残酷和黑暗。当我重临世界之日,诸逆臣皆当死去!

翻译结果:我是童莲琅,表面上天真单纯,实则精明敏锐。你们无法欺骗我,因为从一开始,我就已经为你设下了计划。我才是棋手,而你只是棋子;如果你与我为敌,你终将明白什么是真正的残酷与黑暗。当我重返这个世界之日,所有叛徒必将死无葬身之地!

平均用时:1.14s

歇斯底里是崩溃,底里歇斯是美味。

翻译结果:歇斯底里是崩溃,而歇斯底里是美妙的。

平均用时:0.60s

皇帝感叹道:“孤的胜,你们都看在眼里,孤的败。”然后就退朝了。

翻译结果:皇帝叹息道:“你们都曾见证过我的胜利,现在就看看我的失败吧。”说完便退朝了。

平均用时:0.72s

自定义指令

Qwen-MT 同时支持术语干预、自定义指令、翻译记忆等功能,例如在翻译场景中遇到较多专业词汇,可以提前指定这些词汇及其翻译结果,在程序内 建立字典。

用户还可以通过一段 自然语言文本 描述领域和要求,作为翻译的提示。

我们输入同样的文本,要求 Qwen-MT 分别用 严谨正式的直译风格 和抒情美感的诗歌风格 进行翻译,比较输出结果。

A quiet threat to London’s position as a bustling world financial center is starting to show on the sweaty white collars of the city’s commuters.

严肃正式:伦敦作为全球金融中心的繁荣地位正面临一个潜在的威胁,这种威胁开始在城市通勤者的汗湿白领中显现出来。

抒情美感:伦敦作为全球金融中心的繁华地位,正悄然受到威胁,这种威胁已开始在城市通勤者们汗湿的白领领带上显现。

用时:0.88s(严肃)/0.71s(抒情)

Some of us get dipped in flat, some in satin, some in gloss. But every once in while you find someone who’s iridescent, and when you do, nothing will ever compare. 严肃正式:我们有些人被浸在平滑中,有些人被浸在缎面中,有些人被浸在光泽中。但偶尔你也会遇到一些人,他们闪耀着彩虹般的光芒,一旦遇见了这样的人,其他一切都将无法与之相比。

抒情美感:有人被岁月打磨得平滑如缎,有人则闪耀着光泽。但偶尔,你总会遇到那么一个光彩夺目的人,一旦遇见,便再也无法用其他事物来比拟。

用时:0.87s(严肃)/0.85s(抒情)

总体感受

速度极 快,200 字的文本仅需 2.5 秒,多数情况下输出时间控制在 1 秒以内。

回译检验的结果与原文大体保持一致,能够修正少量的错别字,理解文言文和俗语的能力不错,但对过于抽象的自然语言(如谐音梗笑话)理解有限。

此外,模型能自动识别不同语言。

用户可以通过领域提示调整输出结果的语言风格,但需明确关键词,领域提示语句目前仅支持英文。

使用方法

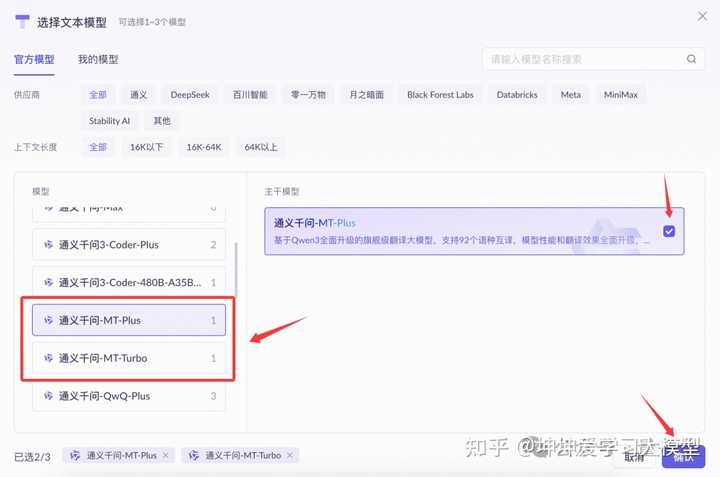

在阿里云百炼的模型广场可以选择体验 Qwen-MT-Pro 和 Qwen-MT-Turbo。

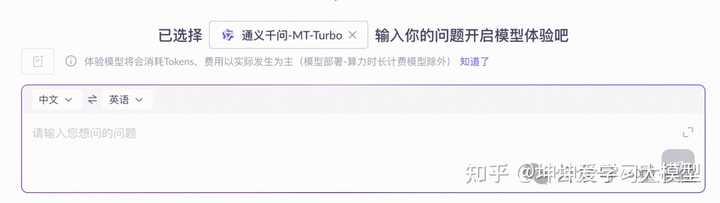

选择后即可进行试用,单次可输入的最长文本量为 6000 字。

输入内容后可进入对话界面,右侧可选择附加功能(术语干预、翻译记忆、领域提示),每次输出将显示使用的 token 数量。

也可以调用 Qwen API,详细代码请参考官方操作文档。

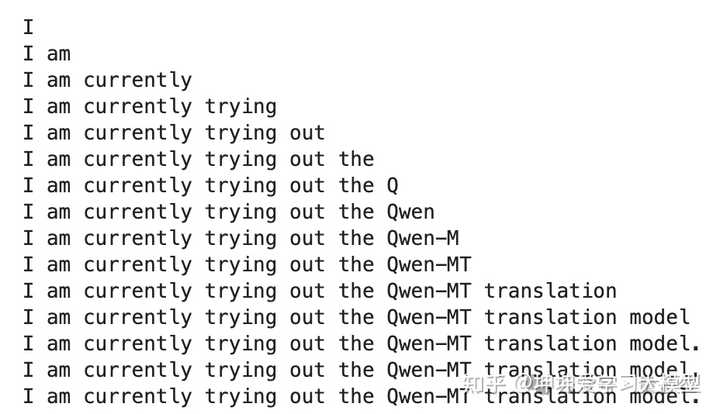

结果支持流式输出。

如何学习大模型 AI?

由于新岗位的生产效率高于被取代岗位的生产效率,因此整个社会的生产效率实际上得以提升。

但具体到个人,情况如下:

最早掌握 AI 的人,将会比那些较晚掌握的人拥有竞争优势。这一原理在计算机、互联网和移动互联网发展的初期都是适用的。

我在一线互联网企业工作十余年,指导过不少同行与后辈,帮助很多人获得了学习和成长。

我意识到有许多经验和知识值得与大家分享,同时也希望凭借我们的能力和经验解答大家在人工智能学习过程中的疑惑。因此,即使在繁忙的工作中,我仍坚持进行各种整理和分享。但由于知识传播途径有限,许多互联网行业的朋友无法获得正确的资料进行学习和提升,故此我将重要的 AI 大模型资料,包括 AI 大模型入门学习思维导图、优质 AI 大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整的 AI 大模型学习资料,朋友们如需可点击下方卡片免费领取【确保 100% 免费】

2025 最新 AI 大模型学习资料合集,允许白嫖,学完拿下大厂 offer,存下吧很难找齐的!