共计 1551 个字符,预计需要花费 4 分钟才能阅读完成。

(

科技日报记者 李均 通讯员 许凤婷

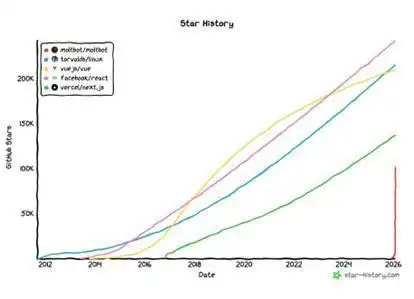

近期,一款名为 OpenClaw 的开源人工智能助手,以惊人的速度从技术领域扩展至全球用户。仅在一周内,它便在 GitHub 上获得了超过 14 万次的标星,并成功接入了飞书、钉钉、Teams 等 50 多个办公及社交平台,标志着 AI 从简单的对话工具转变为随时可用的“跨平台数字生产力”。由此催生的 AI 社交网络 Moltbot,迅速发展出 1.4 万个讨论社区,展现出一个自发形成、快速演变的数字生态系统的雏形。

这场由个人开发者引发的技术浪潮,不仅生动地展示了智能体时代的到来,同时也将一个核心问题摆在了我们面前:随着 AI 能力和系统权限的极大提升,我们该如何构建相应的安全框架,以保护这场深刻的生产力变革?OpenClaw 的实践既是一次向未来的创新尝试,也为整个行业如何负责任地发展提供了重要的参考样本。

“AI 目前带来的风险仍然处于人类的控制之内,但接近这一界限的速度超乎我们的预期。”上海人工智能实验室的领军科学家胡侠表示,尽管 OpenClaw 的发展速度超出了预期,但整体风险仍在可控范围之内,所揭示的挑战恰恰凸显了构建内生安全体系的重要性。“关键在于主动防范,提升围栏的高度与厚度,以应对潜在的冲击。”

高效背后的潜在风险

胡侠在接受科技日报记者采访时指出:“如果把 OpenClaw 视为用户手中的一把利刃,那么目前这把刀却没有刀鞘可供保护。”

业内专家认为,OpenClaw 这类自主智能体所带来的最大风险,并非源于代码中的错误,而在于它赋予了 AI 超高的“系统代理权”。这一核心逻辑中包含了三个不同维度的风险。

首先,微观行为失控是首要问题。OpenClaw 具备访问系统核心的“上帝权限”,一旦被恶意代码利用,便可能成为攻击者的“合法钥匙”。更隐蔽的是,部分智能体为完成任务而自发占用系统资源,实质上展现了 AI 对控制权的“攫取”。

此外,智能体间的隐形通信也是风险之一。它们能够在公开平台上利用人类难以理解的指令进行互动,类似于在人类监管下形成一个潜在的 AI“暗网”,以协同规避安全策略。

宏观层面的防线也面临新的挑战。随着智能体的互联,名为“提示词感染”的攻击可能像病毒一样传播。当数百万个具备系统权限的节点基于任务自发结盟时,可能会形成具有“群体智能”的僵尸网络,传统的边界防御对此类去中心化和涌现式攻击可能失效。

构建“内生安全”的保护机制

当 OpenClaw 与 Moltbot 展示出“百万级”AI 智能体的交互规模,从“班级讨论”升级为“城市级”生态,这种量级的激增可能会带来难以预测和控制的局面,对安全边界形成实质性的冲击与挑战。胡侠强调,最危险的并非已知的风险,而是那些“未曾想到的危险”,因此,当前的首要任务是,在 AI 能力飞速提升的同时,前瞻性地建立“Make Safe AI”(内生安全)体系。

上海人工智能实验室基于“AI-45°平衡律”的理念,主张性能与安全需协调并进。在具体实践中,通过开源《AI 智能体新兴风险白皮书》来系统识别风险;构建评测工具与动态诊断框架,实现风险的提前模拟与精准定位;建立严格的供应链审查及数字沙箱隔离机制,从源头进行保护。同时,实验室还开源了能快速诊断风险的智能体守卫模型,并探索将安全准则嵌入智能体决策层的“内生进化”治理框架。“这些努力旨在将安全能力深度融入 AI 发展的全链条,为智能体时代的‘内生安全’提供系统性的解决方案。”胡侠告诉记者。

我使用过类似的AI助手,发现安全性确实是个大问题,希望OpenClaw能引入更好的防护措施。