共计 3705 个字符,预计需要花费 10 分钟才能阅读完成。

6 月 19 日,字节跳动的研发负责人洪定坤介绍了与 TRAE 合作的首个开源项目。根据公开信息,

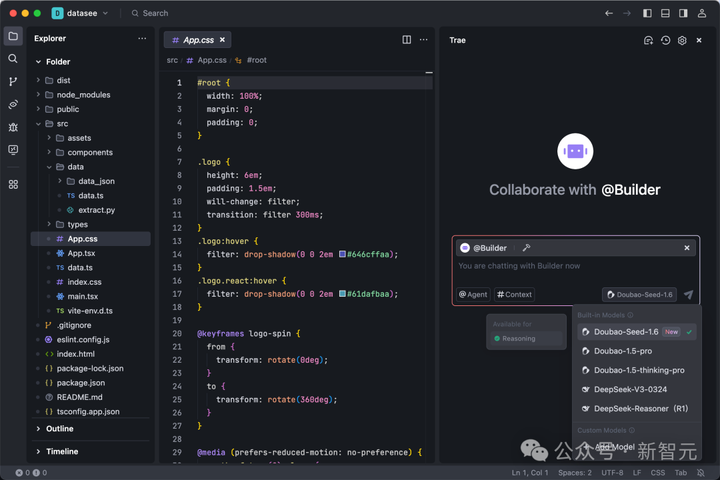

TRAE 具备的两个基本功能“代码补全”和“局部代码生成”能够根据上下文自动推断和完成代码,这为提升编程效率提供了有力支持。

同时,TRAE 实现的“自然语言编程”并非简单的“产品经理描述功能,再由 AI 开发”。在“积流成江”APP 的开发过程中,依然是工程师主导,关注的更多是编码逻辑和技术方案本身。一个 300 行的功能,可能只需 200 字的方案描述。

此外,底层模型的强大代码能力也是此次开发顺利完成的重要因素。此次 TRAE 使用的 doubao-dev 模型基于字节跳动最新发布的豆包 1.6 系列。TRAE 团队在豆包 1.6 的基础上进行了针对工程开发场景的进一步训练。

字节跳动方面表示,TRAE 的用户在近日内应已接收到最新的豆包 1.6 更新,这将进一步提升开发效率。

对此,有使用过的业内人士能否分享一下体验?如何看待当前 AI 的开发水平?

创造一款 AI 编程产品,再利用此产品进行 AI 编程,这样的体验是怎样的?

未来的 AI 开发模式将呈现何种形式,开发者与 AI 的结合将激发出多大的创造潜力?

或许字节跳动的研发负责人 洪定坤 能够为我们解答这些疑问。

最近,他将自己使用 AI 编程完成的首个项目——英语学习应用 「积流成江」(Streams to River) 进行了开源。

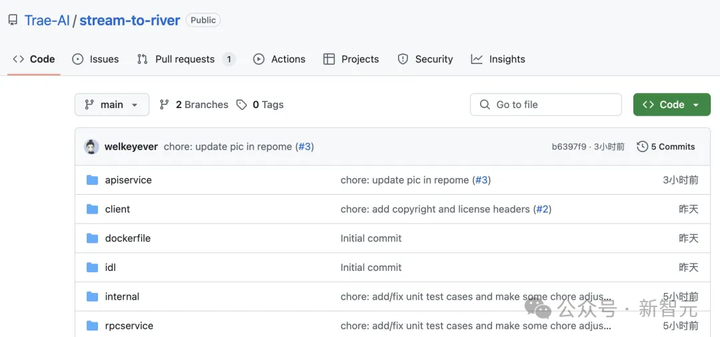

GitHub 链接:https://github.com/Trae-AI/stream-to-river

更令人惊讶的是,洪定坤提到此次开发中约 85% 的代码是通过自然语言与 AI 对话生成的,甚至在这三天内他还忙于公务。

他所使用的工具正是字节跳动研发的 TRAE——一款 AI 原生的集成开发环境,其名称是 The Real AI Engineer 的缩写。

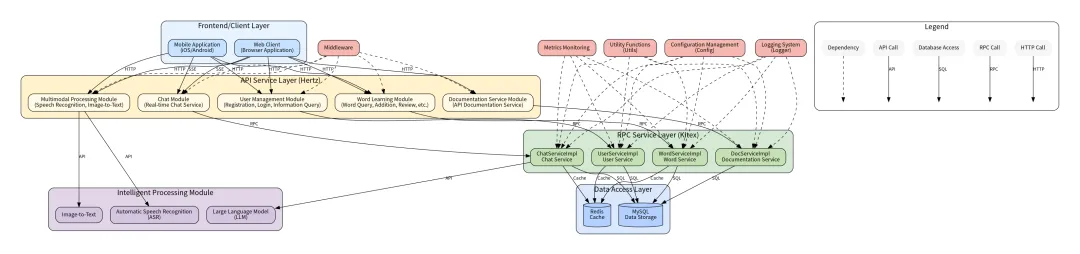

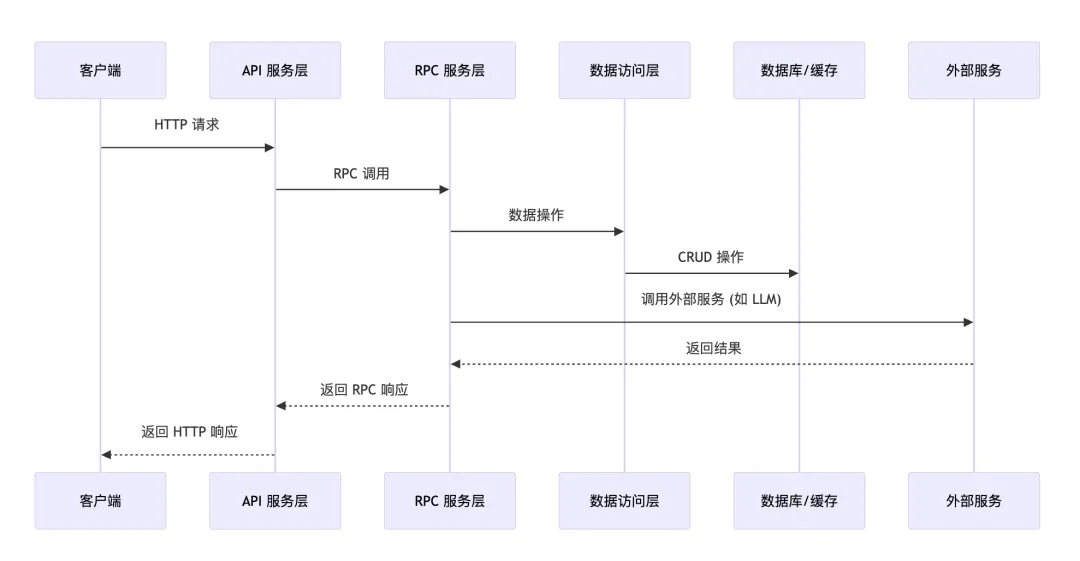

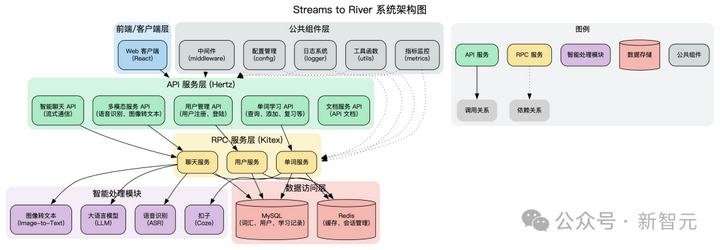

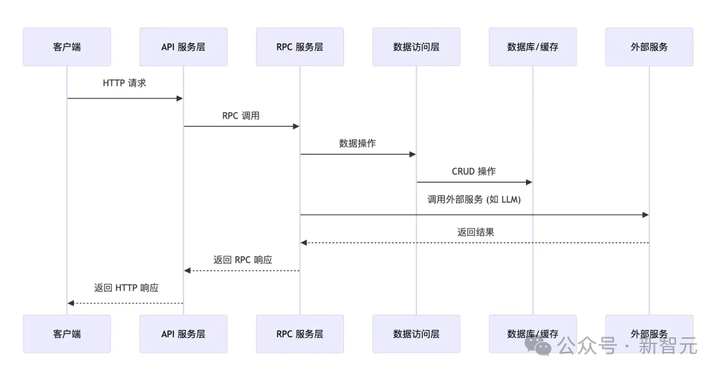

从技术角度来看,积流成江是一个基于 Hertz 和 Kitex 框架的单词学习与语言处理微服务系统。

该系统提供了用户认证、单词管理、复习进度追踪、实时聊天、语音识别及图像转文本等完整功能模块解决方案。

采用前后端分离的架构,主要由 API 服务层、RPC 服务层、数据访问层和智能处理层构成。

系统架构展示

组件调用关系图

技术高管与 AI 共同编写的代码水平如何?感兴趣的读者可以直接前往 GitHub 查阅。

3 天内“写”出一个上线产品

以往,开发一个类似于积流成江的应用可能至少需要几周甚至一个月的时间。

然而,洪定坤通过自身实践证明,现在的 AI 编程已经能够通过“自然语言”迅速完成一个项目。

想象一下,一场重要的发布会(火山引擎 Force 原动力大会)即将召开,时间紧迫。

作为技术副总裁,洪定坤需要在会上分享公司在 AI 编程领域的核心产品——TRAE。

他本可以准备一份精美的 PPT,列举各种数据和功能,向大家展示这个工具的强大。

但他认为,这样还远远不够。

“怎样才能让大家 真切感受到 AI 编程的魅力?”

“或许作为开发者和用户,分享我使用 TRAE 的过程 会更加生动和真实,”他在心中思索。

真实的体验才是关键。

洪定坤提到他在工作中有学习英语的需求,但常规的单词背诵软件存在两个问题:

1. 学习的单词与工作生活中实际使用的单词存在脱节。

2. 在工作中需要的单词缺乏合适的练习场景。

如何解决这个问题呢?

正好现在的大模型,例如字节的豆包,可以很好地与我们进行对话。

那么,是否可以将这两种功能结合起来呢?

于是,积流成江便应运而生。

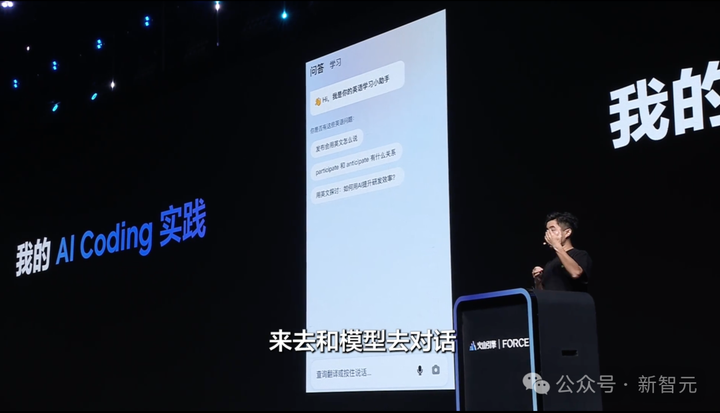

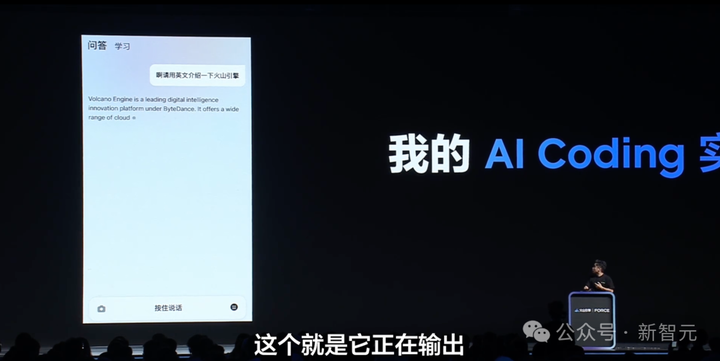

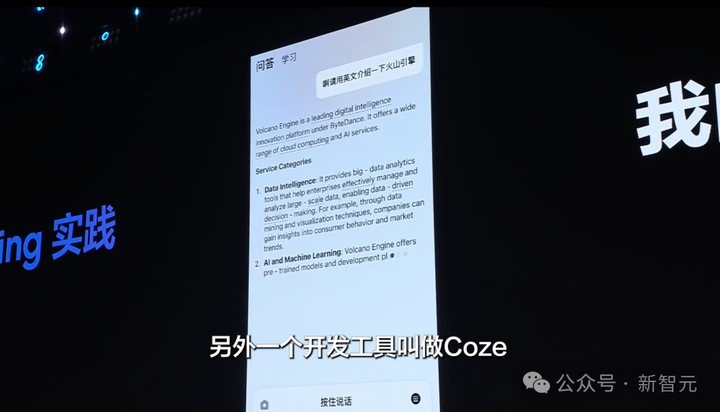

在大会上,洪定坤现场演示了如何通过“语音”让积流成江生成一段介绍火山引擎的文本。

生成的文本中自动对一些特定的、需要学习的英文单词进行了划线标注。

值得一提的是,这一功能是借助字节的另一款产品 Coze 智能体实现的。

洪定坤表示,他已经有一段时间没有在一线写代码,感觉“有些生疏”,但是在 TRAE 的帮助下,仅用了 3 天便开发出了这个完成度极高的英语学习应用。

在这个过程中,最关键的是,洪定坤大部分时间是用编程逻辑的 “自然语言” 来实现过去的工程化开发过程。

用他的话来说:

一个 300 行的功能,仅需 200 字的方案描述。

这个产品并非只是个 Demo,已经正式上线,体验地址为:https://sstr.trae.com.cn

我们全程体验过后,难以置信这是一个仅花了 3 天时间便完成的产品,几乎达到了 100% 的完成度:

- 融入了聊天界面,能够主动定位 / 制定学习材料

- 并能自动识别对话中的英文单词

- 点击英文单词可切换至学习分支

- 便捷地将单词收录到学习集中

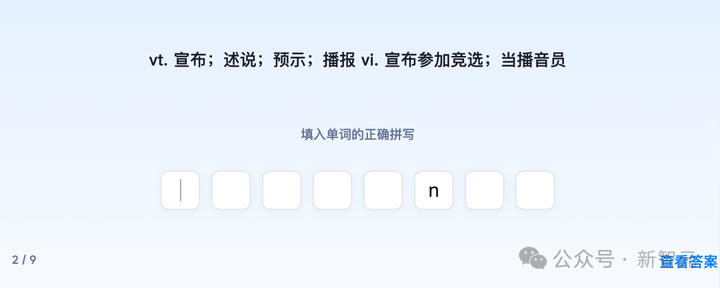

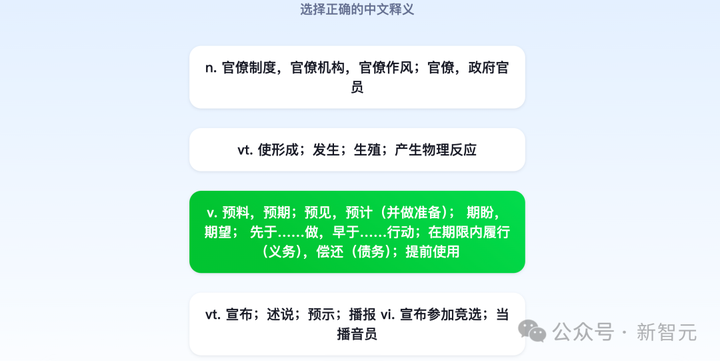

- 还拥有背单词软件应有的复习功能,从发音、释义到单词拼写等各个方面强化学习

积流成江如何帮助你记忆单词?

积流成江这款产品的复杂性究竟有多高,为什么洪定坤在 Force 大会上给予重点介绍?

其实,这款产品的复杂性展示了 当前 AI 编程已经进化到何种程度。

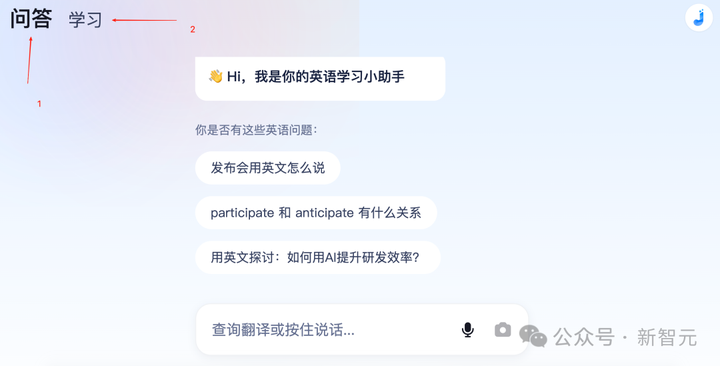

积流成江设有两个页面选项卡。

第一个选项卡集成了豆包的大模型能力,用户可以通过文字或语音与大模型互动。

生成特定的学习文本。

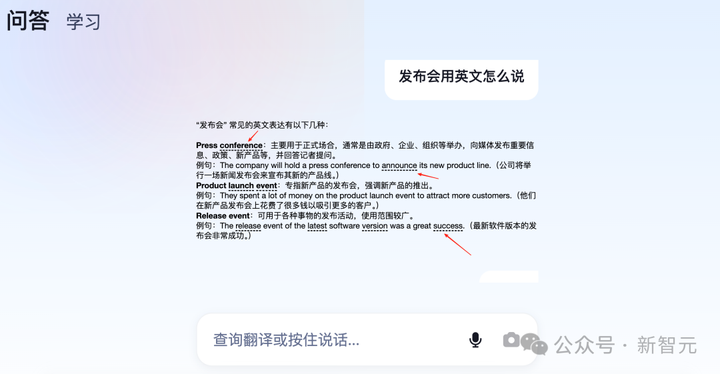

当生成内容时,积流成江会对特定单词进行下划线标记,点击后即可打开单词卡片。

未来编程的新纪元:字节的 AI Coding 探索之路

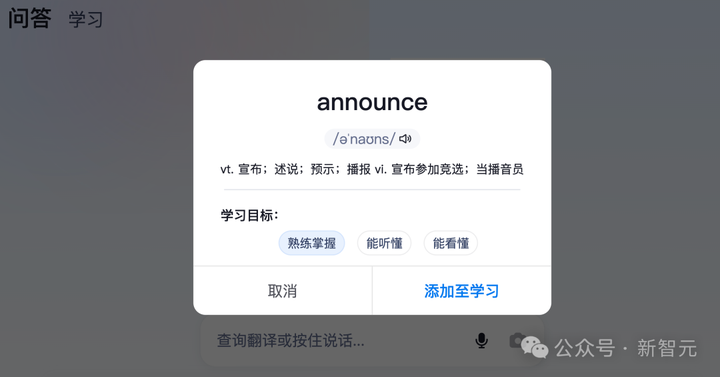

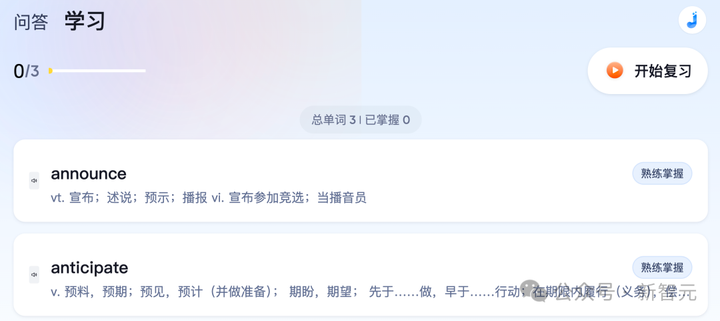

在单词卡中,学习目标可以通过「添加」按钮轻松设置,并纳入学习选项卡。

一旦点击复习,就能进入学习界面。这里提供了多种功能来帮助巩固单词,比如通过补全单词和选择其中文释义来加深记忆。

在使用过程中,积流成江最令人欣慰的一点是,借助大模型的能力,用户能够根据自己的兴趣来自定义学习内容,从而极大提高了学习的积极性。

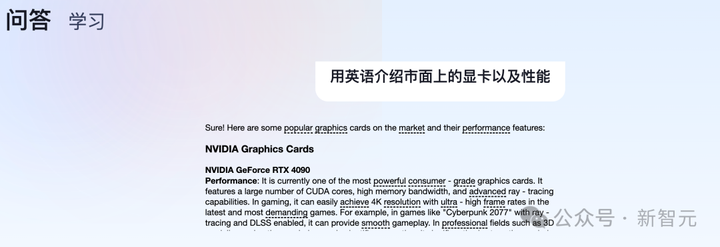

例如,如果我希望了解显卡的知识,就可以要求积流成江用英语生成相关的文本,看到满屏的 RTX 4090,确实让我对学习充满了动力。

此外,用户还可以依据工作需求生成相应的文本。

字节为何坚定不移地投入 AI 编码领域?

今年,AI Coding 的热潮带动了一系列国外产品如 Cursor、Copilot 和 Windsurf 等,那么国内是否有类似的产品呢?

答案是肯定的!那就是 字节在年初推出的 TRAE。

字节作为一家重视技术研发的公司,研发效率直接影响着企业的整体效率。

洪定坤表示,他们在 AI 编码方面的探索已有一段时间。自从 GPT-3.5 发布后,他们意识到这是大模型的一个极佳应用方向。

因此,TRAE 的名称寓意着「真正的 AI 工程师」,象征着 AI 大模型将为编程带来实质性的变革。

尽管大模型起初并未具备足够的能力来完成复杂的编码任务,但在过去不到一年的时间里,其进展超出了所有人的预期。

诸如 GPT-4.1、Gemini 2.5 Pro、Claude Opus 和 DeepSeek-R1-0528 等底层模型在编码能力上都取得了显著的突破。

同样,字节在火山引擎 Force 原动力大会上发布的豆包大模型 1.6,在编程能力上也有了显著提升。

这使得 AI 编码真正具备了落地的可能性,并有望引发编程领域的颠覆性变革——就像洪定坤所展示的,通过自然语言实现一个真实且可用的工程项目。

首先,TRAE 提供了两个核心功能:「代码补全」和「局部代码生成」,在编写代码时可以根据上下文自动推测和补全代码,从而提升编程效率。

其次,利用 TRAE 实现的「自然语言编程」,不仅仅是简单的「产品经理描述功能,然后让 AI 开发」。

积流成江 APP 的开发过程依然是一种典型的工程师开发方式,除了功能外,更注重编码逻辑与技术方案。

更为重要的是,底层模型的能力提升,使得 TRAE 的开发效率得到了质的飞跃。

洪定坤表示,他们开发 TRAE 的愿景包含几个关键点:

· 技术普惠,AI 让每个人都能成为开发者

每一次重大的技术革命都是对参与者的重新筛选。

在上一次互联网数字革命中,编程语言作为计算机历史上的一项伟大发明,以其简洁优雅的语法和语义规则,明确地定义了指令,促使计算机完成不同任务。

无论技术如何演变,字节始终坚信,代码依然是未来最重要的工具,能够使计算机完成各种复杂的任务。

代码是数字世界中的基础生产力工具。

而 AI 的出现,前所未有地 降低了人们掌握代码的门槛。

· 提高研发效率

认真对待开发工具的建设,对公司和开发者个人都有着重要意义,能够显著提升工作效率。

如今,在字节内部,超过 80% 的工程师正在使用 TRAE 等工具辅助开发。

同时,相当比例的代码也是通过 AI 生成的。

· 追求智能极限

最后,字节在大模型的开发工作中,最重要的任务之一便是 追求智能的极限。

编码作为一种高度结构化、逻辑严密的任务,对模型理解复杂语义结构、逻辑推理、算法设计和精确表达提出了很高的要求,能够有效促进模型智能极限的探索。

因此,帮助更多人掌握代码,完成更复杂的任务,提升专业工程师的工作效率,以及推动模型追求更高的智能极限,正是洪定坤和他的团队认真开展 AI 编码工作的原因。

洪定坤通过积流成江展示了什么是真正的 AI 原生开发模式。

在 TRAE 的支持下,或许每个人都有机会成为「真正的 AI 工程师」。

AI Coding 的未来,或许已经悄然到来。

使用TRAE开发时,是否存在对于特定编程语言的支持限制?