共计 1531 个字符,预计需要花费 4 分钟才能阅读完成。

我想知道一个问题:为何国内的大型模型声称处于领先地位,但在实际编程过程中,开发者却更倾向于使用 GPT、Gemini 等国外模型,而非国内模型呢?

首先,让我们探讨一下 AI 编程模型的能力及其评估问题,目前主要面临以下三个挑战:

1. 随着模型能力的提升,评估其性能的方法也变得愈发复杂。当前的大型模型能够出色地完成简单的对话互动、产品展示或数据分析脚本等任务,因此它们之间的差异并不明显;真正的差距体现在复杂项目和棘手 bug 的解决能力上。

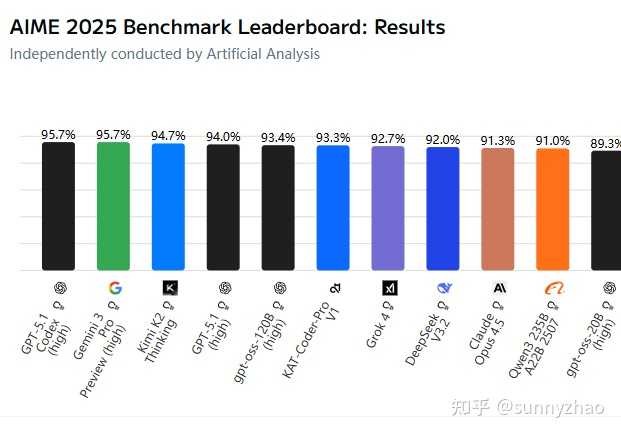

2. 性能评估基准面临饱和问题。例如,MMLU 的分数已经达到上限,而其升级版 MMLU-Pro 中,大多数模型的得分均超过了 80 分,AIME2025 榜单上更是有 10 个模型得分超过 90 分。因此,单纯依赖某一基准的分数,因其饱和性,难以有效比较模型之间的差异。

3. 测评场景与实际应用场景之间的差异,尤其是在编程领域。模型的训练数据大多来源于开源代码的 issue 或 PR,这些问题往往是局部性的,无法全面反映真实场景的复杂性。同时,当前强化学习的训练成本较高,针对真实问题的训练复现仍未找到有效的解决方案,加之上下文和记忆管理技术尚不成熟,因此在解决现实编程问题时,模型的能力仍显不足。

基于以上问题,我们可以从两个角度分析为何国产模型在实际应用中不及国外模型普遍。

根本原因在于模型能力的差距。在编程能力评估标准中,swe-bench verified 是专门针对处理真实 GitHub issue 能力的测评,成为评估模型编程能力的重要基准(不过,其实仅有 500 个经过人工验证的样本,显示出测评基准的覆盖度依然不足)。目前得分最高的是 claude opus 4.5(80.9),紧随其后的是 claude-sonnet-45(77.2)、gpt-5.1(76.3)、gemini-3-pro(76.2),而国内模型中表现最佳的是 DeepSeek-v3.2,得分为 73.1,其它国内模型的排名依次为 kimi-k2 thinking(71.3)、qwen3-max(69.6)、minimax-m2(69.4)、glm-4.6(68.0)。由此可见,国内模型与得分 75 以上的国外模型仍存在明显差距。

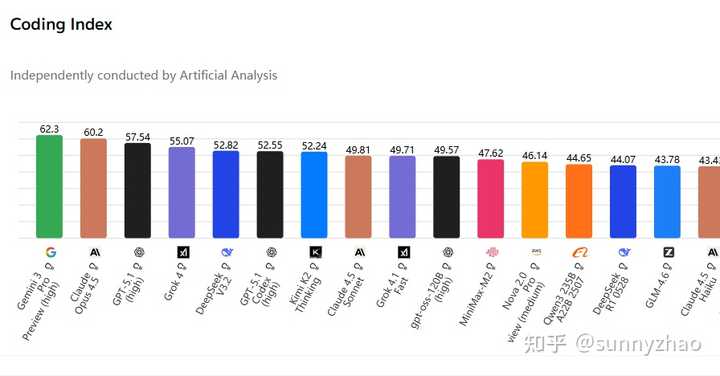

再看一个综合性的编程测评,比如 scicode(科学编程)、livecodebench(新兴竞赛编程)和 terminal-bench-hard(复杂终端编程)等 coding index 测评,前四名均为国外模型(得分均在 55 以上),而 DeepSeek-v3.2(52.82)则排名第四,算是开源领域的一个亮点,超越了 gpt-5.1-codex(high)。因此,通过这些真实编程任务的测评成绩,可以直观地判断出能力差距。

第二个问题是基于编程代理的技术栈和生态的差异。claude 和 codex 较早就开始构建基于自身模型的命令行编程工具,而国内的 qoder、atra 和 codebuddy 等工具则是在最近三个月才发布,因此在编程场景的经验积累、产品优化及强化训练方面,国内模型显然存在后发劣势,需要持续追赶。

总体来看,虽然大多数模型在处理简单编程问题上没有障碍,但即使是前沿模型的能力,仍未达到应对真实场景中复杂编程问题的水平。尽管国内模型的编程能力与国外顶尖模型之间的差距仍然存在,但这一差距正在逐步缩小。

评估标准的饱和性问题,是否意味着我们需要寻找新的评估方式?