共计 6790 个字符,预计需要花费 17 分钟才能阅读完成。

字节跳动推出了 AI 编程助手 Trae 的 2.0 版本,并逐渐开放使用权限。这个新版本引入了 SOLO 模式 —— 一种具备上下文工程能力的系统,能够依据完整信息进行任务的规划与执行,支持从代码编写到功能交付的全流程开发。

SOLO 是 Context Engineer,它是一个能独立生成软件的 AI 工程师,能够取代人类处理开发过程中的琐碎、重复和流程性强的环节。

SOLO 模式被视为从“AI 辅助”向“AI 主导”的一次显著转变。与传统的需手动驱动的智能体或代码补全工具相比,SOLO 能在理解需求的基础上,主动调度工具来完成复杂的开发任务。当前,该系统已支持 Web 应用的全流程交付,未来还将拓展更多的应用场景。

目前已有不少开发者获得了内测资格,大家对 SOLO 模式的实际使用感受如何呢?

感谢邀请,作为 Trae 的核心开发者,我在这个领域已经摸索了半年。今天,我想分享一些关于 《重生之我在大厂搞 AI Coding》 的想法。

总结一下:多图杀猫~

重生之我在大厂搞 AI Coding

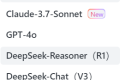

时间线其实很简单:

- 2022 年 11 月 15 日,意外收到了蚂蚁大礼包,促使我重新思考未来的规划,幸运的是我很快加入了字节。

- 2023 年 11 月 15 日,我接到一个电话,被召集到杭州闭关室,开始负责 MarsCode Cloud IDE 团队的云工作区等相关工作,那一年可谓是疯狂的一年。

- 2024 年 11 月 15 日,我再次进入闭关室,经历了又一个疯狂的半年,这也促成了大家看到的 Trae 1.0 和 2.0 的演变。

我常常和朋友开玩笑说,11 月 15 日是我的受难日,重生之我在大厂搞 AI Coding。今年的 11 月 15 日又会有什么新故事呢?我并不知道,但我有些期待。

时间飞逝,已经过去了半年。在上个月的火山引擎 Force 大会上,定坤在主题演讲《聊聊 Al Coding》中分享了Trae 的月活跃用户已突破百万,我们也算是阶段性地交出了一份答卷。

从 MarsCode 到 Trae

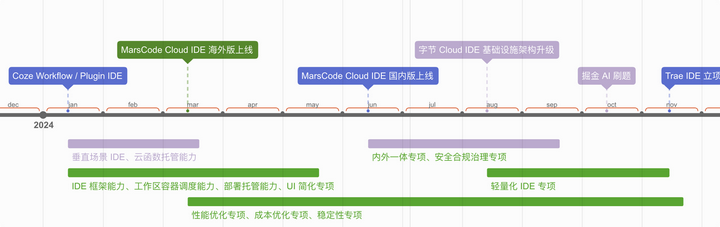

熟悉我们团队的朋友应该知道,2024 年我们推出了许多与 Cloud IDE 相关的产品,包括 MarsCode Cloud IDE、Coze IDE 和掘金 AI 刷题等。字节内部的 Cloud IDE 也有很高的用户覆盖率。

首先,澄清一个概念:Cloud IDE 并不等同于 Web IDE。在我看来,IDE 可以分为前端交互层和业务逻辑层:

- 前端交互层可以在浏览器中运行,也可以在本地的 Electron 中运行,既可以是完整版也可以是轻量版。

- 业务逻辑层可以在用户本地运行,也可以在远程的 K8S 容器中,甚至可以在浏览器的 WebContainer 中运行。

Cloud 意味着 Code Anywhere,以上的交互层和逻辑层可以自由组合,既可以在同一台机器上,也可以通过 SSH 远程连接,甚至通过 iPad 使用。这是我对 Cloud IDE 的理解。

Cloud IDE 的远程容器,我们称之为云工作区,其技术挑战相当巨大:

- 常见的微服务往往是非实时的,且无状态,可以进行负载均衡,容量不足时可逐步扩容;

- FaaS 服务是实时调度的,但无状态,因此可以进行提前预热等;

- Cloud IDE 是 实时调度 + 有状态,每个项目对应一个容器,有磁盘数据依赖,对启动速度极其敏感,用户打开时需要等待初始化和加载才能使用,因为涉及磁盘代码数据,因而是有状态的,不能进行负载均衡,也很难提前预热。

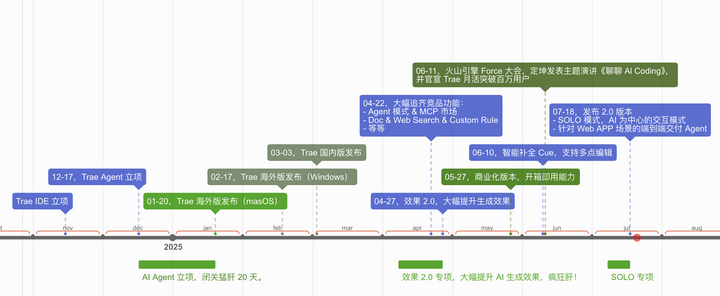

在 2024 年,我们在这一领域投入了大量精力进行优化,不仅将 VSCode 进行了大幅 Rust 化,还深入定制到了 K8S 层面,最终在性能、成本、稳定性等方面取得了显著成果,我们的端到端启动性能 P90 达到了 5 秒,而 GitHub Codespace 需要 30 秒,Google IDX 则需要 1 分钟,这使我们在这一指标上达到了世界级水平。

MarsCode 启动速度 https://www.zhihu.com/video/1930983846276466605

MarsCode 启动速度 https://www.zhihu.com/video/1930983846276466605

然而,技术的成功并不一定意味着业务的成功,许多情况下需要在合适的时机选择合适的路径。对于 Cloud IDE 场景来说,尽管其在字节内部的覆盖率很高,但 MarsCode 作为一款面向消费者的产品,天然受到用户场景的限制,因为国内企业的代码难以上云,而程序员的副项目又不足以支撑产品的健康发展。

因此,在 2024 年 11 月 15 日,我们回到了半山坡,选择了从 Native IDE 这条路重新向 AI Coding 的高峰攀登。当然,我依然坚信 Cloud IDE 的价值,未来它会以云端一体的方式与我们重聚,殊途同归,一个都不能少。果不其然,在 2025 年中,业界也开始关注 Remote Agent 场景,而在这一领域我们有着充分的积累,等待时机即可。

我对 AI Coding 的看法

之前在播客中也提到过:《探秘 AI IDE,对话字节 Trae & 迪魔王 Devmore》

LLM 大模型的本质在于预测下一个字符。与复杂的自然语言相比,编程语言更加简洁、严谨且可预测,因此 AI Coding 领域成为这一波浪潮中的首个 PMF 产品。在这个领域的实践日新月异,几乎每个月都在刷新我们的认知。

标题:AI 编程的未来:从辅助到自主的演变之路

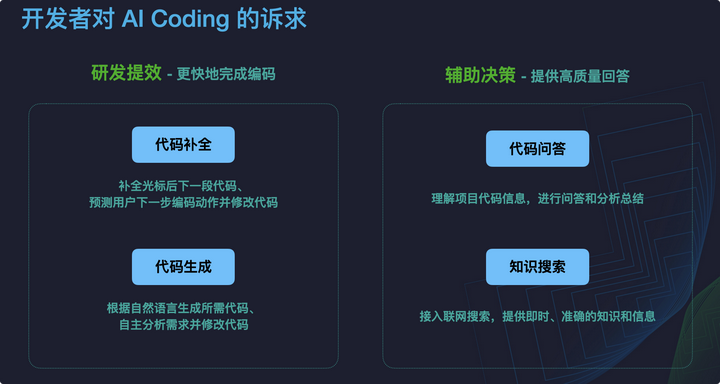

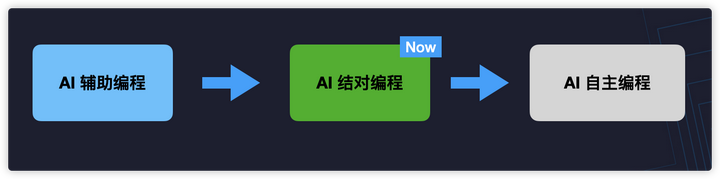

从我的观察来看,AI 编程的发展过程与自动驾驶有一定相似之处,可以划分为几个阶段:AI 辅助编程 → AI 结对编程 → AI 自主编程。目前,我们的 Trae Builder、Cursor Composer 和 Windsurf Cascade 等工具,正是针对 AI 结对编程阶段而开发的。

AI 辅助编程

代码补全

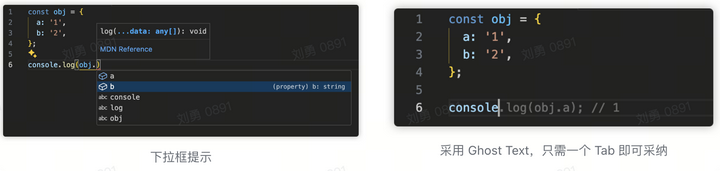

在编写代码的早期,我们主要通过“下拉列表”来选择对象的方法和属性,实现代码提示。

随着 ChatGPT 的问世,我们逐渐明白 LLM 模型的核心在于预测下一个字符。相较于复杂的自然语言,编程语言的简洁与严谨使得其更加可预测。因此,Copilot 的出现为代码补全带来了革命性的创新,其令人赞叹的 Ghost Text 交互方式,程序员只需按一个 Tab 键便可迅速采纳,极大激发了开发者的积极性。

然而,这种方式的局限性在于只能补全新增代码。为此,Codeium 和 Cursor 在 Super Completion(也称为 Tab Tab)上进行了进一步创新。比如,当一个前端地区下拉列表的语言从英文切换为中文时,如果你修改了第一行某个字段,只需再按一次 Tab,便能一键更新所有相关字段。最近,我们也推出了 Trae Cue 超级代码补全功能。

从“代码提示”到“代码补全”,再到“超级补全”,这体现了 AI 编程能力的跃升。

Trae Cue 超级补全 https://www.zhihu.com/video/1930973686283896348

代码生成

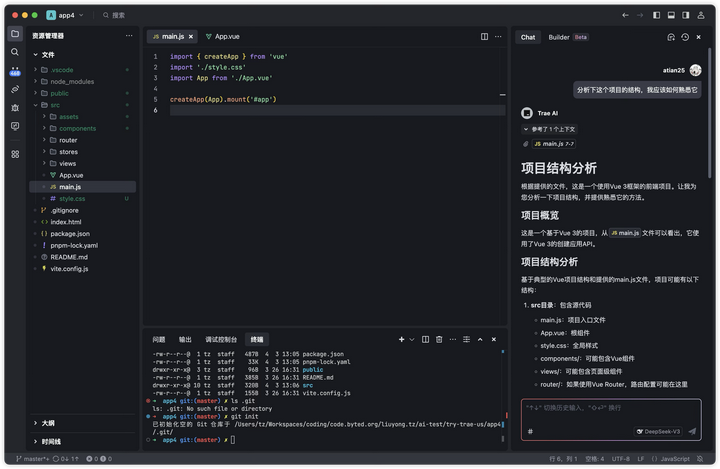

接下来,我们讨论一下“代码生成”。在 ChatGPT 刚推出时,程序员们受到的另一个冲击是可以通过对话生成算法或页面,但这需要在 Chatbot 中手动输入,然后再复制到 IDE,过程相对繁琐。

难道我们不能在 IDE 中直接与 AI 进行对话吗?因此,IDE 中开始出现了 SideChat,更多是以插件形式存在,如 Copilot Chat 和 Codeium 等。其优势在于能够直接获取 IDE 和代码仓库的上下文,从而避免了繁琐的手动复制操作。

虽然这种方式看似复杂,实际上其原理非常简单。举个例子,如果你对 AI 说“请帮我实现这个 HTTP 请求函数”,它背后实际上是在拼接一段信息:“用户正在打开 xx 文件,光标位于 xx 行,该行的函数名和注释为 xxx,最近访问的文件有 a、b、c,整个项目的目录结构为 xxx,现在要求在当前位置实现一个 HTTP 请求逻辑。”然后将这段信息传递给 LLM 生成代码,最后再进行合并。与手动对话 ChatGPT 并没有太大差别,IDE 只是帮助你组装了合适的上下文。

这一技术的关键在于:项目理解能力、上下文裁剪、模型能力以及工程实践能力。Cursor 在这一领域表现出色,这得益于 Claude Sonnet 3.5 的出现,使模型的能力达到了一个新的里程碑,去年引发了一阵热潮。

此时,开发者能够在 IDE 中与 AI 共享相同的上下文,避免繁琐的转述。接下来需要解决的问题是生成的代码如何自动合并,而不必手动复制到各个文件,这便是 Fast Apply 代码合并 的场景。

简单来说,就是如何让 AI 生成适合的代码并自动将其合并到相应的位置。目前有多种实现方式,比如全文重写、搜索替换代码片段、Diff 合并等,业界也有许多实践结合使用。Cursor 则训练了一个 Fast Apply 小模型,而我们 Trae 则支持多种合并方式。

以上两种能力的阶段,我称之为 AI 辅助编程。

AI 结对编程

AI Agent 的定义

随着 AI 能力的不断提升,用户的需求也日益复杂,我们希望 AI 能具备更多的自主性,像一个高潜力的实习生与我们共同进行结对编程,这种角色被称为 AI Agent。

那么,一个典型的 Agent 是如何运作的呢?Manus 最近的文章提到:

『在接收用户输入后,Agent 通过多项工具来完成任务。在每次迭代中,模型会根据当前上下文从预定义的动作空间中选择一个动作,然后执行该动作以产生观察结果。这个动作和观察结果会被附加到上下文中,形成下一次迭代的输入,这一循环持续进行直至任务完成。』

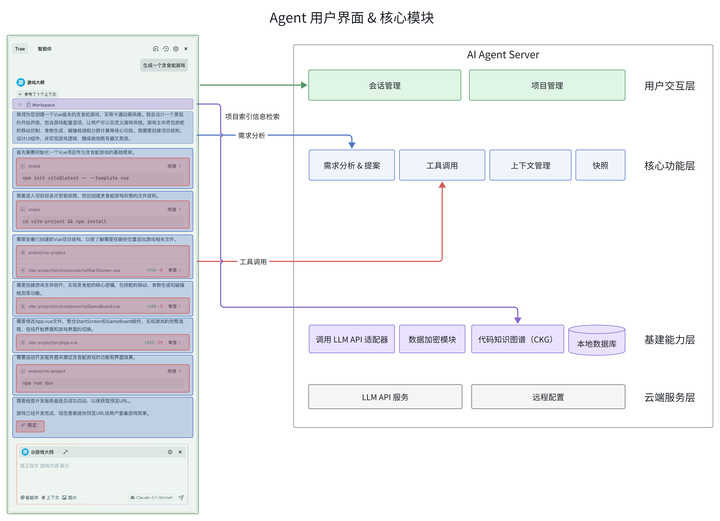

简而言之,Agent 的核心在于具备 思考能力 、 调度能力 、 上下文环境感知能力 及工具调用能力。它能够感知自身所处环境,并根据接受的目标进行思考与任务拆解,调度各种工具来实现目标。

小插曲:如果在使用 Trae 时发现需要手动“应用”,请务必检查 Chat 对话框中是否缺少 @builder。下次会进行优化!

Trae Agent 1.0

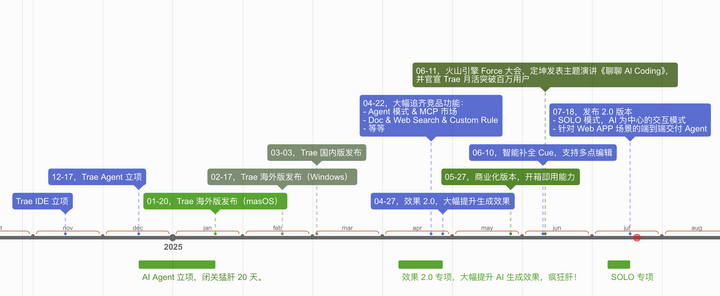

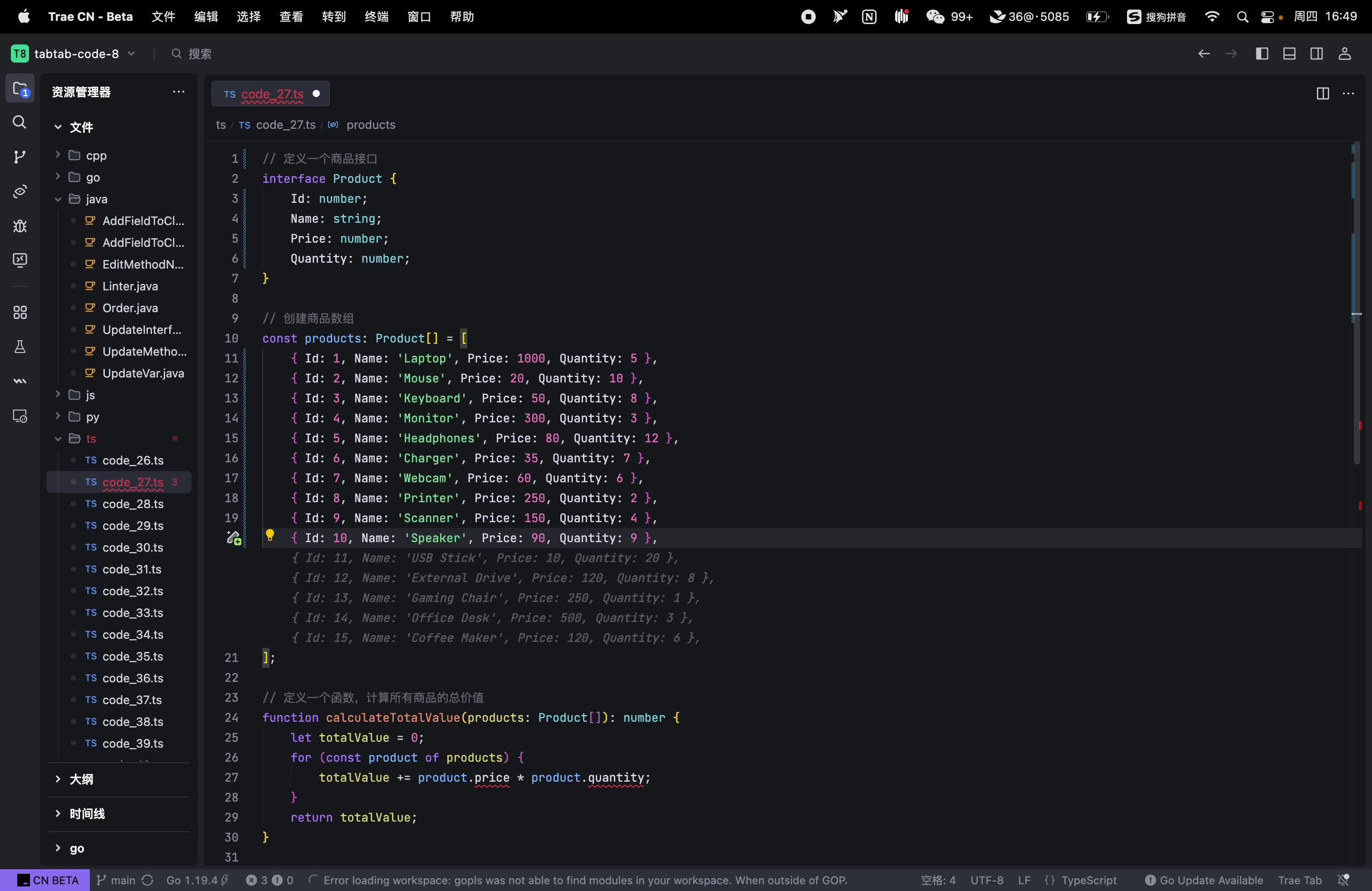

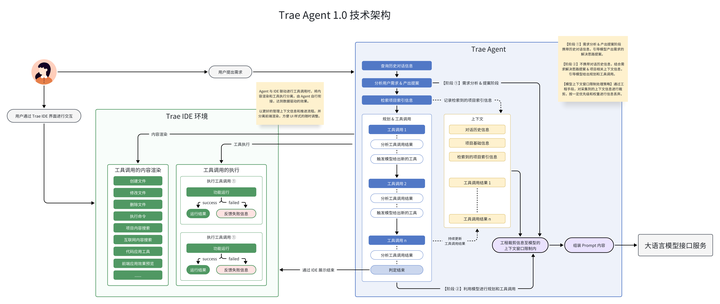

Trae Agent 于 2024 年 12 月 17 日立项,经过 20 天的努力,推出了大家所见的 Trae 1.0 版本。

在 Agent 1.0 的架构中,由于当时大模型的能力尚未足够强大,我们的流程更依赖于 Workflow,即思考、规划、执行、观察的循环进行。它在 Trae IDE 环境中运行,利用 IDE 的功能收集信息、构建上下文,并依靠大语言模型进行思考和规划。同时,通过 IDE 提供的文件操作和命令行操作等功能进行工具调用,以满足编码相关的需求。

除了 Agent 的流程外,系统中还有代码知识图谱(Code Knowledge Graph)、Fast Apply 代码合并等功能。

顺便吐槽:有时看到社区中有人说 AI IDE 只是 LLM 的外壳,只能说他们连领域认知的门槛都没碰到。

Trae Agent 2.0

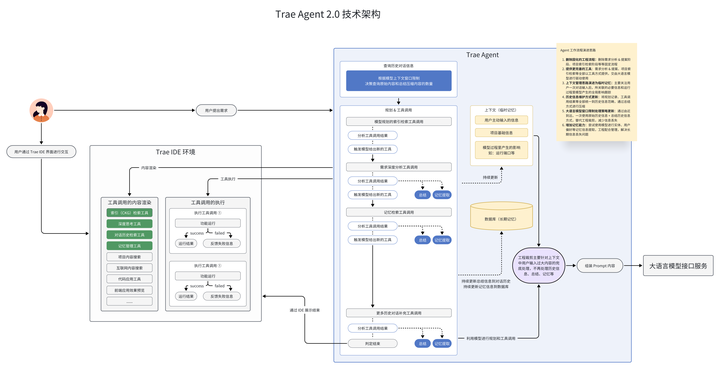

随着大量用户反馈的收集,我们发现 1.0 架构在许多场景下的表现并不理想。同时,随着 LLM 大模型能力的不断增强,依赖于 Proposal + Plan 固定工作流程的方式,反而可能导致模型能力受限,限制了其发挥。

Agent 2.0 发布:赋能 LLM 的全新架构

在 2025 年 4 月 8 日,我们经过 21 天的集中攻坚,推出了 Agent 2.0 架构。此次升级的关键在于赋予 LLM 更大的自主性,使其能够主动理解需求、感知环境,并有效使用工具进行操作和反馈,极大地提升了其能力表现。

与此同时,我们对各类工具进行了专项优化。例如,File 工具的代码合并成功率得到了提升,而代码召回则被抽象为 Search Codebase 工具,供 AI 根据需要调用,并且支持语义化的多路召回。

与 AI 进行斗智斗勇的过程,确实是个耐人的考验。让我们分享一个关于 PUA 的案例:

Trae Agent 3.0

Agentic 和 Workflow 并非简单的开关,而是一个连续的光谱。我们的架构旨在提供持续迭代的能力,使 LLM 在能力足够的领域实现更高的自主性,而在其尚不擅长的领域,通过固定流程整合专家经验,随着模型的演进以低成本替换相关节点。

【付费内容,投简历后可读】

【付费内容,投简历后可读,后端:https://job.toutiao.com/s/5IEbI9PKBco】

【付费内容,投简历后可读,前端:https://job.toutiao.com/s/mMPAHQSoPFA】

【付费内容,投简历后可读】

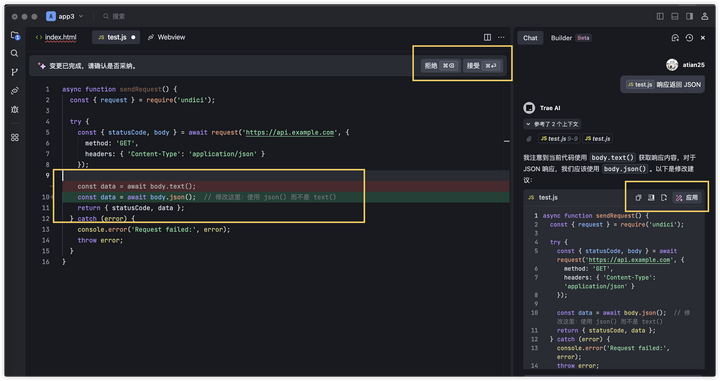

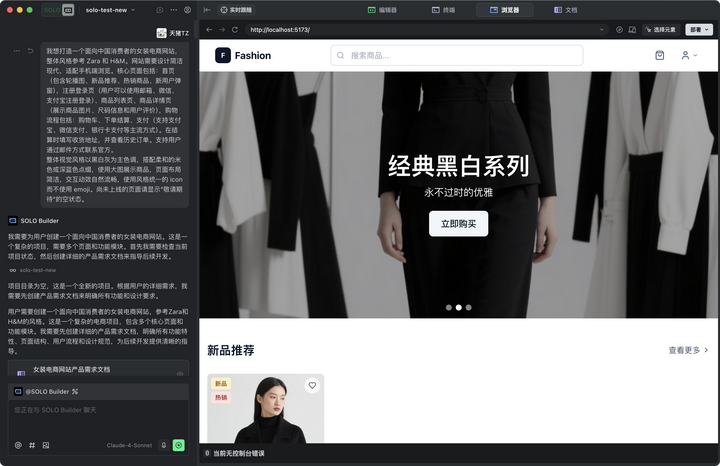

Trae SOLO 模式

随着 Trae 的不断演变,我们逐渐认识到 AI 与 IDE 之间的主导关系正在发生逆转:

- 过去是程序员在 IDE 中编写代码,而 AI 仅起辅助作用。

- 现在更像是 AI 主导编码过程,IDE、浏览器、终端等只是其工具之一。

因此,我们探索了 SOLO 模式,旨在将协作方式从「AI 辅助 IDE」升级为「AI 主导 IDE」。在 SOLO 中,AI 可以利用内置的编辑器、浏览器等多种工具,未来还将整合更多功能。

此次发布的 2.0 版本主要包含:

- 以 AI 为核心的互动模式 SOLO。

- 内置针对 Web APP 场景的端到端交付 Agent,未来还将推出更多 Agent。

目前该版本仍处于预览打磨阶段,欢迎大家积极使用并反馈意见。

以下是一些参与测试用户所取得的成果:

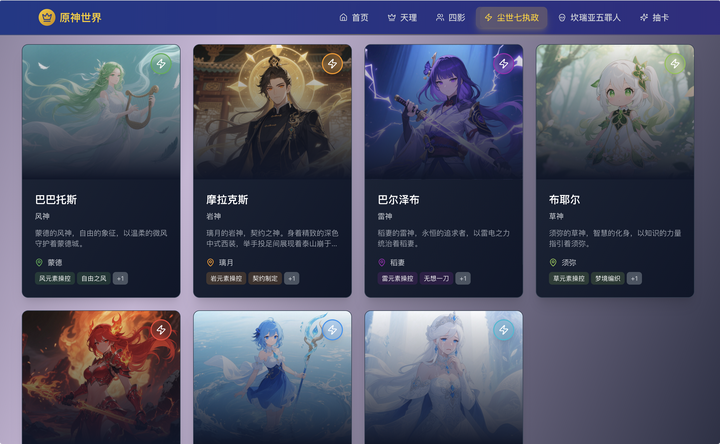

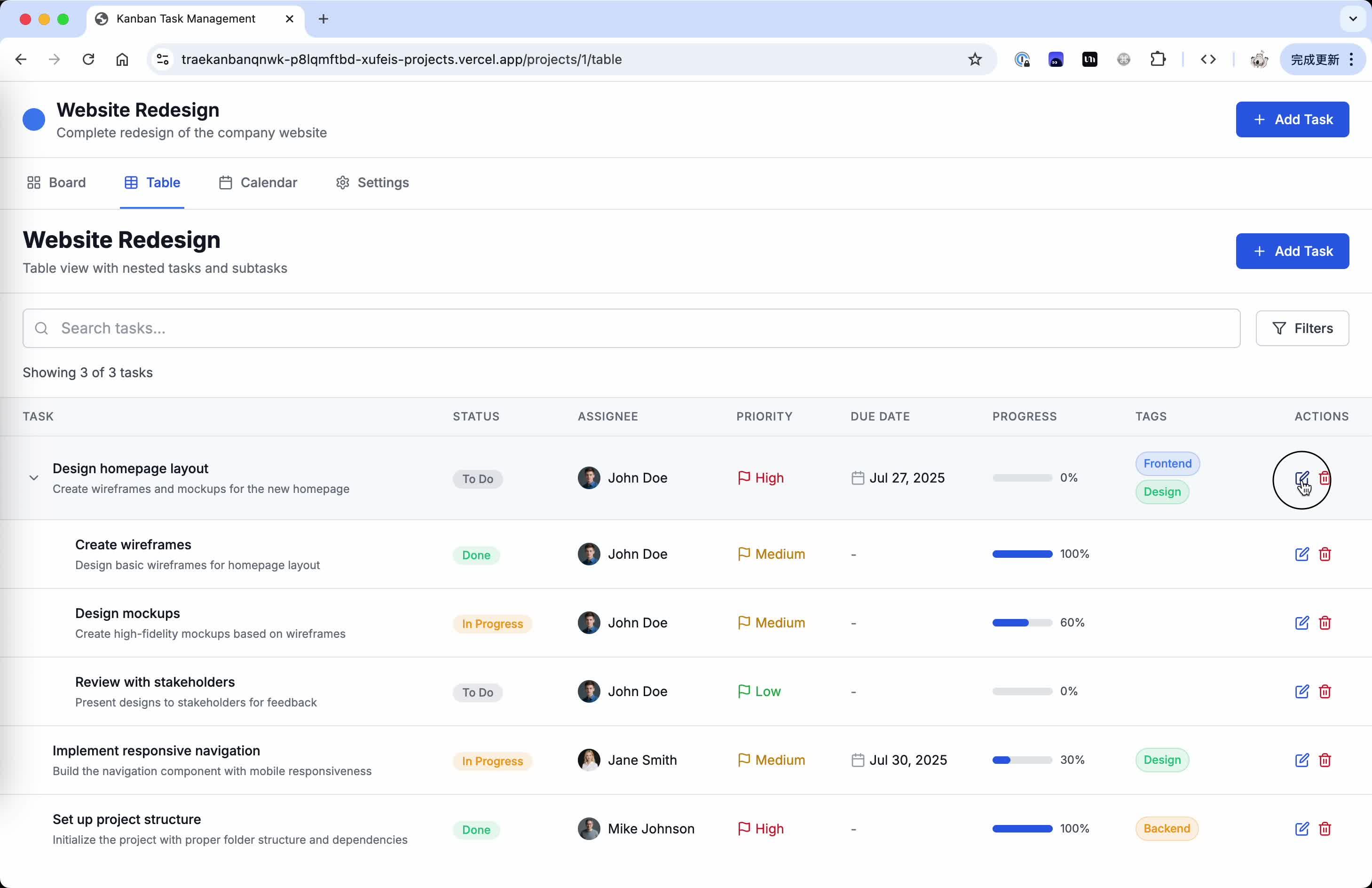

⬆️ @徐飞 制作的任务看板:https://traekanbanqnwk-lfne48lzn-xufeis-projects.vercel.app

目前海外版已经发布,传送门:https://www.trae.ai。由于资源有限,我们仍在进行定向邀请测试,大家可以关注官方 Twitter 或技术运营团队的通知,我这边也没有 solo code。

传送门:关于 TRAE SOLO Code 后续发放方式的说明

如何与 AI 实习生有效合作?

我一直认为 AI 是:每个人都能拥有的高潜力实习生。

如今,许多人对 AI 编程的评价各异,有的赞叹不已,有的则批评其效果不佳,这其实源于未能找到与不同阶段的实习生相处的方式,未能妥善管理自己的期望,常常短期内高估,长期则低估其潜力。

我认为,AI 是每个人的专属高潜实习生。对于现阶段的 AI,应该给予适当任务、提供合理的指导和信息输入,随时准备给予支持,并在必要时接手,就如同对待一个真实的实习生一般,管理得当才会有所成效。

- 甩手掌柜 → 不提供充分的上下文,仅凭一句话的需求期待 AI 完成复杂项目。

- 超出能力范围的期望 → 它是程序编写工具,你若期待它生成不当内容,那是不切实际的。不同的模型有各自的使用方式。

- 招聘标准过低 → 想让 claude 4 完成的任务,却只愿意使用 openai 3.5 的免费版本。

- 一分价钱一分货 → 期待以 20 美元的月费实现 2000 美元的 token 使用效率。

观察社区中人们对 AI 编程的评价,颇具趣味,似乎能窥见他们如何培养实习生及新人的方式:

- 一些人会事无巨细地拆解任务,提供明确的信息指导,严格控制进程。

- 另一些则适度放权,仅提供必要的信息,并随时准备介入支持。

- 还有部分人缺乏耐心,遇到问题时会立即发火,随意放任,自己动手解决,只留下简单的任务给 AI。

总结与加入我们

记得项目刚立项时,TL 对我们说过:“我们拥有意愿、能力、机会、想法和支持,我坚信我们能够创造出世界级的产品。”起初我将其视为一种“愿景”,但在 2024 年底回顾 MarsCode 的技术指标,2025 年中关注 Trae 的百万月活数据,看到团队不断积累的洞见,我突然意识到,我们确实在踏实前行的道路上,我深感信服。

本着“预研一代、部署一代、分享一代”的理念,我们正在落实 Trae Agent 3.0 架构,以支持 Multi Agent 和 Remote Agent 等探索。

漫漫长路任重道远,我将在 AI 编程这条路上不断探索,尽管与许多行业先行者相比还有许多需要学习的地方,但请相信我们在认真对待这一事业。

专业生产力工具的颠覆性创新,必将全面重塑开发者的认知和开发方式,未来的 IDE 可能不再是当前“以代码为中心”的形式,这一变化或将在未来三年内发生。我们每个人都应学会如何与 AI 协作。

最后,我们团队规模小但充满干劲,欢迎大家加入 Trae,杭州、北京、上海、广州、深圳均有基地,正在招聘前端、后端和 AI 等人才。