共计 3210 个字符,预计需要花费 9 分钟才能阅读完成。

机器之心的最新动态

机器之心编辑团队

最终,Cursor 决定迈出自主训练大型语言模型的步伐。

Cursor 2.0 终于正式发布!

就在刚刚,Cursor 推出了两项重磅更新:全新的编码模型 Composer,以及一个支持多个智能体并行协作的新界面。

这一发展具有深远的意义。尽管 Cursor 一直备受青睐,但其曾被视为“AI 时代的 VS Code”,原因在于它之前只能依赖 Claude、GPT 等第三方模型。这一限制既是 Cursor 的起步点,也是它发展的桎梏。

Composer 的发布,标志着 Cursor 摆脱这一局限的“独立宣言”,同时也意味着其从“AI 外部框架”蜕变为“AI 原生平台”。

自主研发的模型 Composer

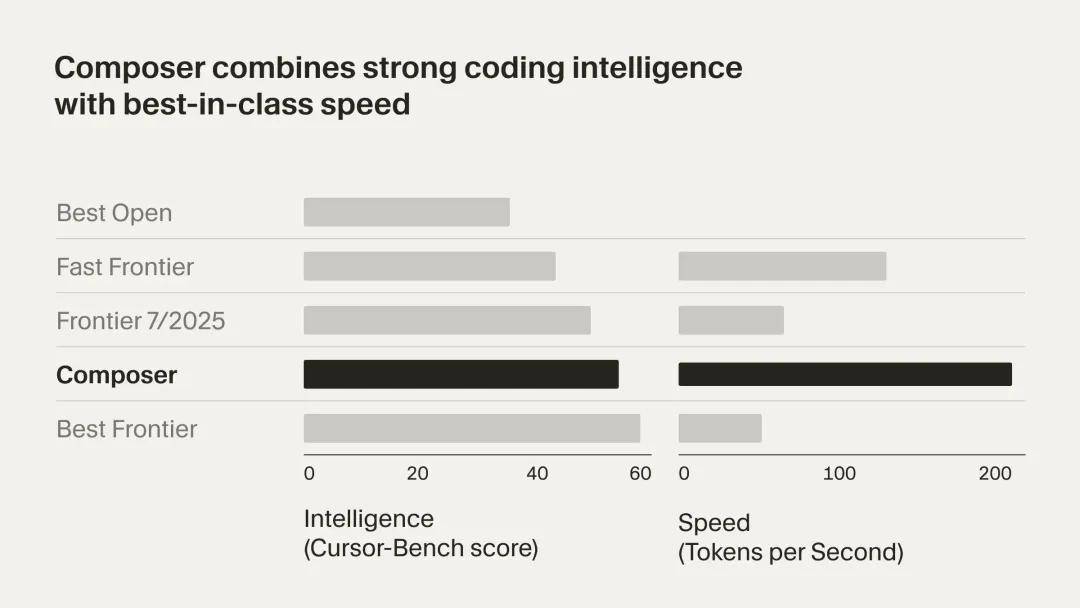

作为一款前沿的模型,尽管 Composer 在智能水平上不及 GPT-5 等顶尖模型,但其生成速度却令人瞩目,达到了同类智能模型的四倍之多。

在各项基准测试中,Composer 达到了前沿编码智能水平,同时其生成速度每秒可达 250 个 token——约为领先快速推理模型的两倍,四倍于同类前沿系统。(注:Cursor 将发布的模型划分为多个类别:“最佳开源”(如 Qwen Coder、GLM 4.6)、“快速前沿”(Haiku 4.5、Gemini Flash 2.5)、“2025 年 7 月前沿”(年中可用的最强模型)和“最佳前沿”(包括 GPT-5 和 Claude Sonnet 4.5)。Composer 在与中端前沿系统的智能水平对比中,创造了所有测试类别中的最高生成速度纪录。)

此模型旨在提供低延迟的智能体式编码体验,大部分回合均能在30秒内结束。早期的使用者反馈其快速迭代功能十分顺畅,因此他们愿意将其用于处理复杂的多步骤编码任务。

官方指出,Composer 的训练过程使用了一系列强大的工具,这些工具涵盖了整个代码库的语义搜索,从而在理解和处理大型代码库方面表现得尤为出色。

在训练期间,Composer 被赋予了一整套用于生产的搜索和编辑工具,旨在高效应对各种复杂问题。

这一模型的开发动力来源于 Cursor 团队在打造自家补全模型 Cursor Tab 过程中的经验积累。

他们意识到,开发者通常希望能够使用既智能又支持互动的模型,以便在编码时保持专注和流畅。在研发阶段,他们尝试了一个名为 Cheetah 的原型智能体模型,以便更深入理解高速智能体模型的作用。Composer 则是在此基础上进行了智能化的升级,确保在交互体验中实现足够的速度,从而使编码过程始终愉快流畅。

在架构方面,Composer 被设计为混合专家(MoE)模型,具备生成和理解长上下文的能力。它通过在多样化的开发环境中进行强化学习,针对软件工程进行了专门化的优化。在每次训练迭代中,模型都会接收到问题描述,并被要求生成最佳的响应,无论是代码的调整、方案的规划还是信息性的解答。模型不仅能利用文件的读取与编辑等基本工具,还能够调用更强大的功能,例如终端命令和全代码库的语义搜索。

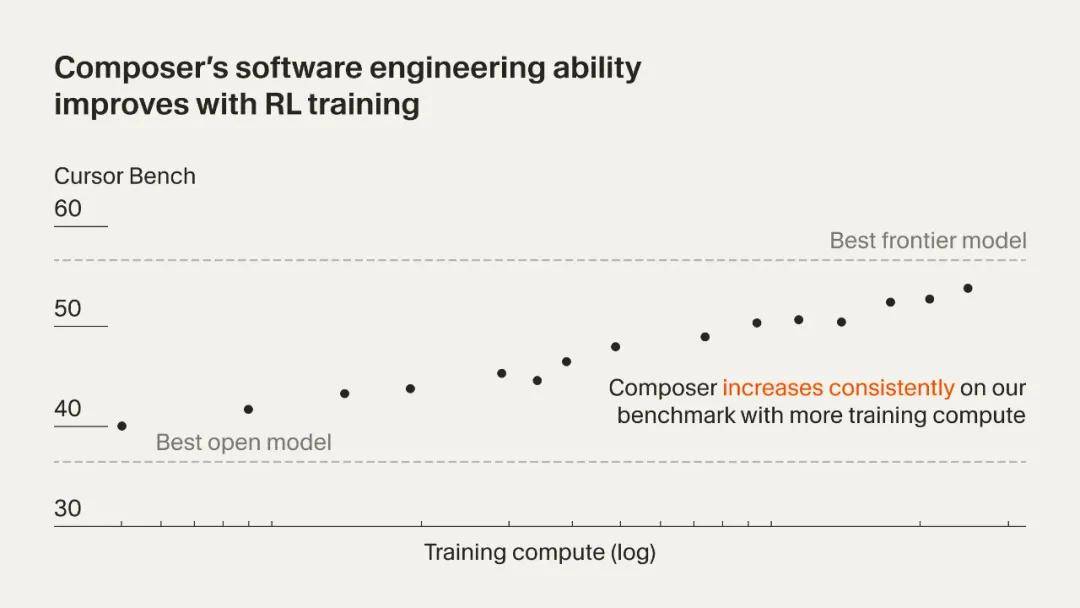

Cursor 2.0:智能开发环境的全新变革

为了评估发展成效,团队创建了一种尽量与软件开发者实际需求相符的评测体系。新的基准测试,名为 Cursor Bench,包含了来自 Cursor 工程师和研究人员的真实智能体请求,并配备了经过人工精心筛选的优秀解决方案。这项评估不仅关注智能体的准确性,还考量其在遵循代码库的抽象和软件工程实践方面的表现。

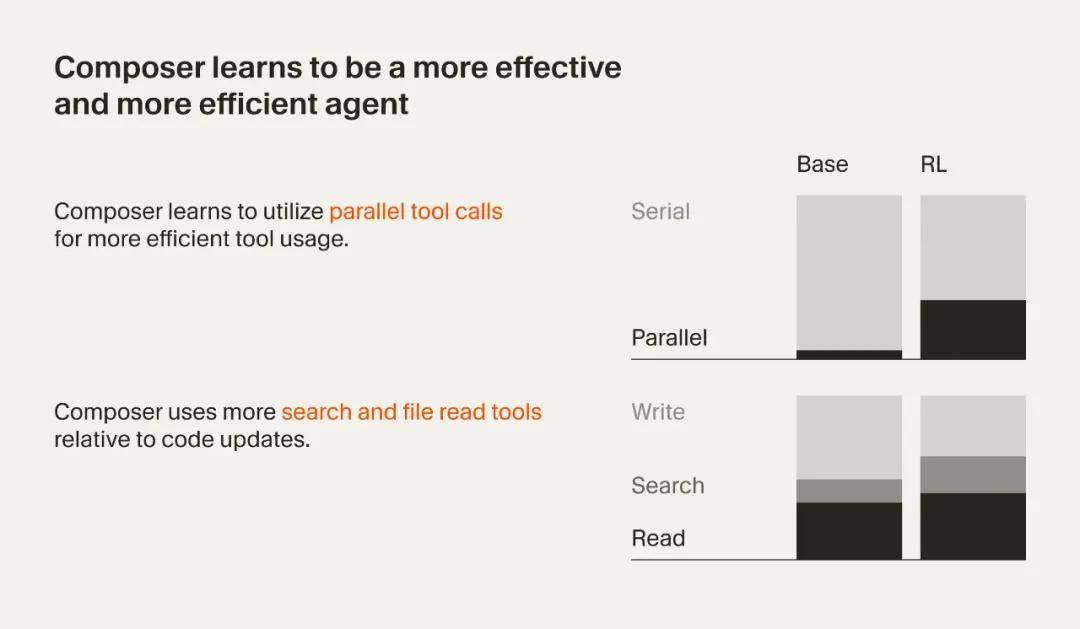

通过强化学习,他们能够更有针对性地提升模型的性能,以更好地满足高效软件工程的需求。考虑到响应速度在交互式开发中的重要性,团队鼓励模型在工具使用上做出有效的选择,并在条件允许的情况下实现最大程度的并行处理。同时,他们训练模型以减少不必要的回答,避免无依据的言论。在强化学习的过程中,模型还自发掌握了一些实用技能,比如进行复杂搜索、修复 linter 错误,以及编写与执行单元测试。

Cursor 的工程团队已经在日常开发中广泛应用 Composer,表明其具备相当的成熟度和稳定性。

目前,Composer 已经完全融入 Cursor 2.0,这是该公司智能开发环境的一次重要升级。

多智能体界面

Cursor 的用户界面也进行了重新设计。

根据其博客的介绍,这一版本更为集中,彻底围绕“智能体”展开,而非依赖传统的文件结构。这使得用户可以专注于所需的结果,而将繁杂的细节交由智能体处理。当需要深入查看代码时,用户也能在新布局中轻松打开文件,或随时切换回经典的 IDE 界面。

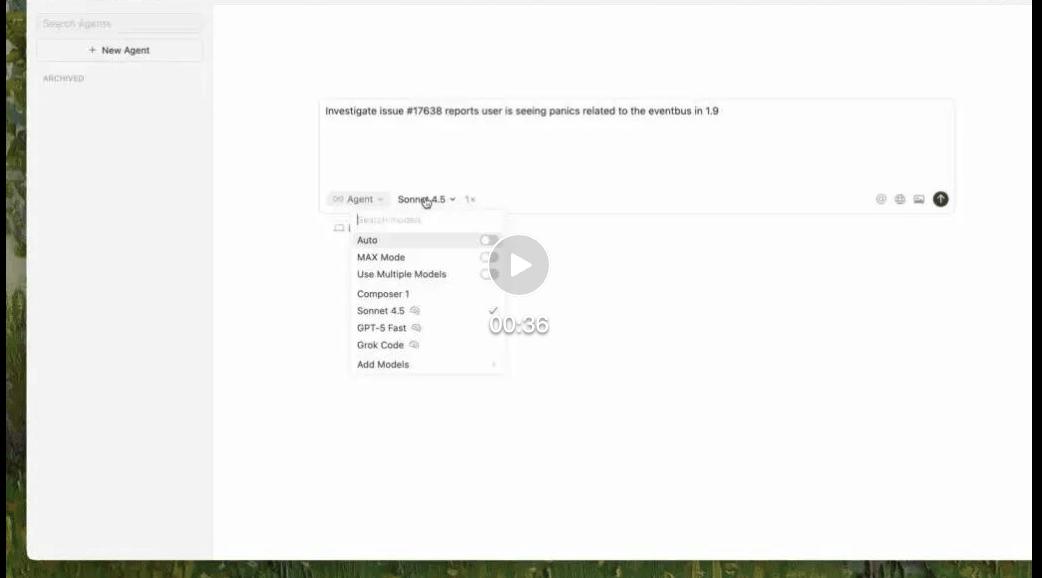

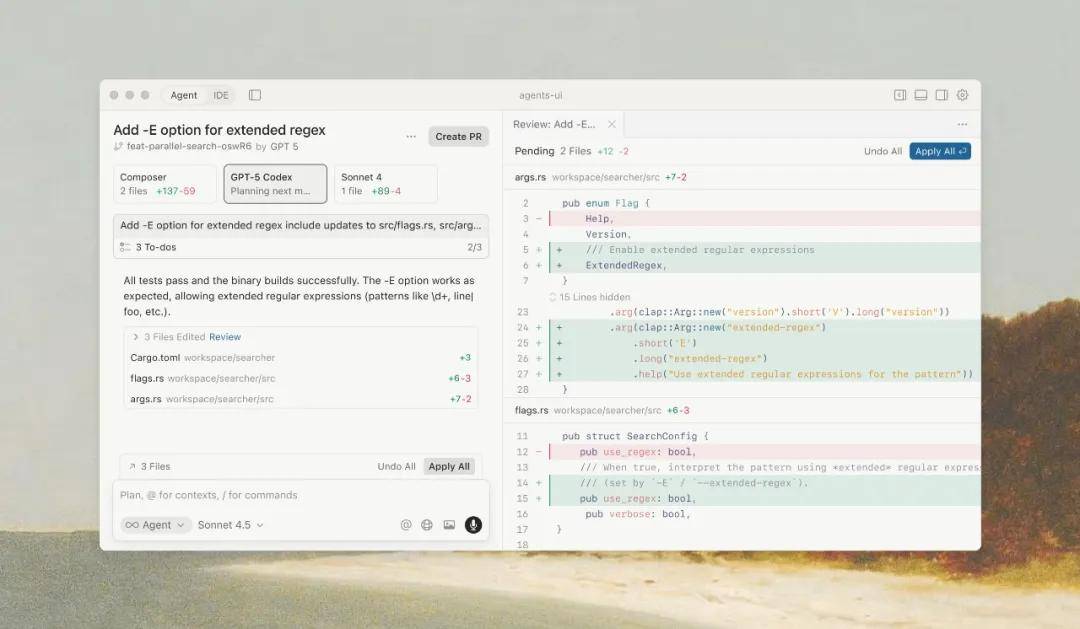

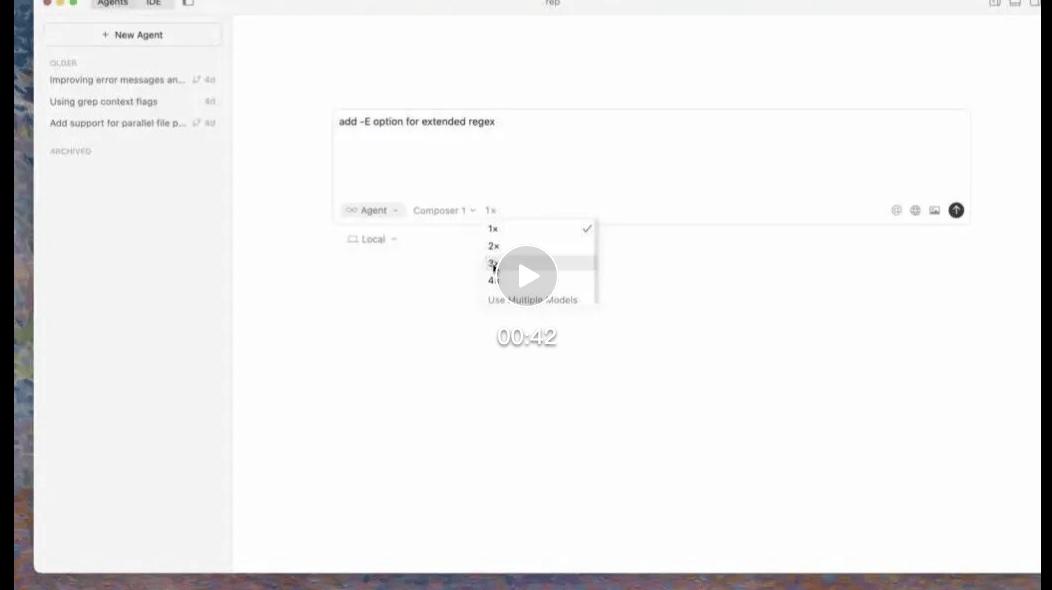

Cursor 2.0 支持多个智能体并行运行,它们之间不会相互影响。这得益于 git worktree 和远程机器的支持。Cursor 表示:“我们甚至发现,让多个模型同时解决同一问题并选择最佳方案,能显著提升最终结果,特别是在更具挑战性的任务上。”

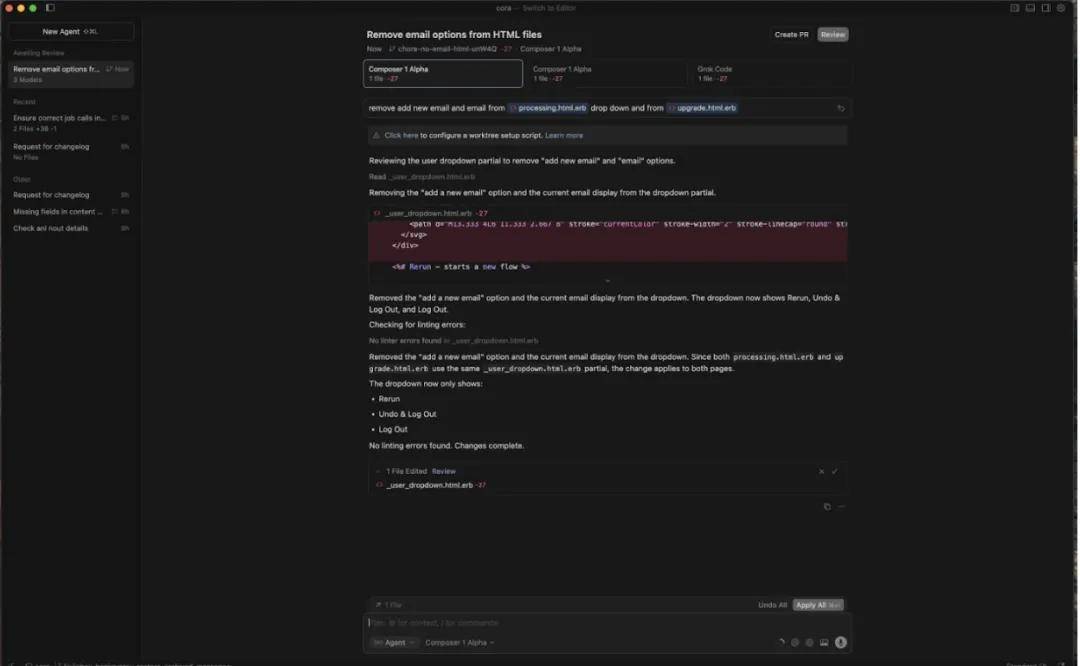

在 every.to 的博客中,分享了一些测试案例。例如,从下方示例可以看到,在同一任务的执行过程中,顶部栏显示了三个不同的模型:Composer 1 Alpha 进行过两次运行,而 Grok Code 仅运行了一次。

这篇博客提到:“如今,开发者能够并行运行多个 AI 智能体,每个智能体负责项目的特定部分,而这些部分被称作工作树(work tree)。就像一群实习生各自负责不同章节,并同时向我汇报进展一样。”

此外,Cursor 官方也指出,随着智能体在编码中的使用增加,出现了两个新的挑战:代码审查和变更测试。

针对这两个问题,Cursor 2.0 开始提供解决方案。它允许更迅速地审查智能体的变更,并在必要时深入代码进行分析。

同时,Cursor 还开发了原生浏览器工具,使其能够测试工作并持续迭代,以确保最终结果的准确性。

基础设施

要高效训练大型 MoE 模型,必须在基础设施和系统研究上投入大量资源。团队基于 PyTorch 和 Ray 开发了定制的训练基础设施,旨在大规模环境下支持异步强化学习。通过将 MXFP8 MoE 内核与专家并行以及混合分片数据并行结合,他们能够在原生低精度下进行模型训练,这样可以以极低的通信开销将训练扩展至数千块 NVIDIA GPU。值得一提的是,MXFP8 训练还实现了更快的推理速度,无需在训练后进行量化。

在强化学习过程中,团队希望模型能调用 Cursor Agent 框架中的各种工具。这些工具可以用于代码编辑、语义搜索、使用 grep 查找字符串以及执行终端命令。考虑到 Cursor 的规模,为了高效调用这些工具,必须在云端并行运行数十万份隔离的沙盒编码环境。因此,团队对现有的 Background Agents 基础设施进行了重构,重写了虚拟机调度器,以适应训练运行的高突发性和大规模需求。最终,他们成功实现了 RL 环境与生产环境的无缝衔接。

网友点评

作为备受瞩目的 AI 编程工具,Cursor 的此次重大更新自然吸引了大量关注。

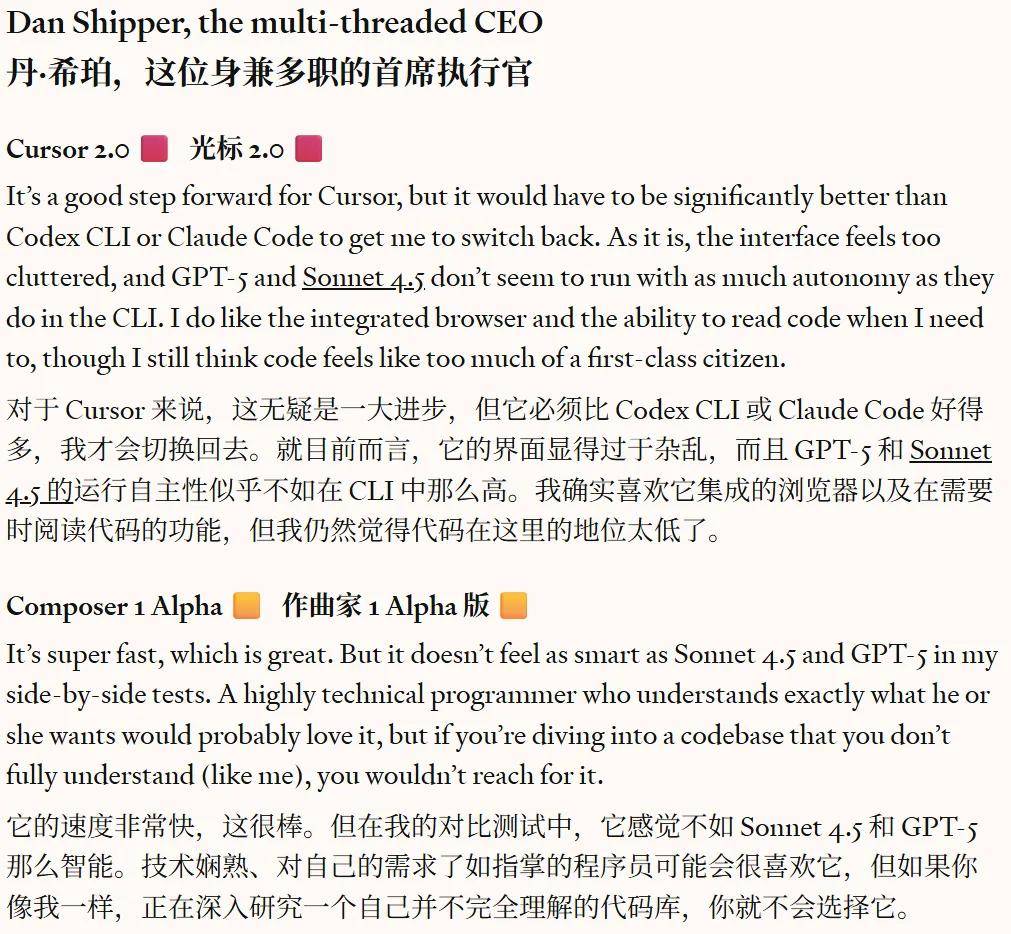

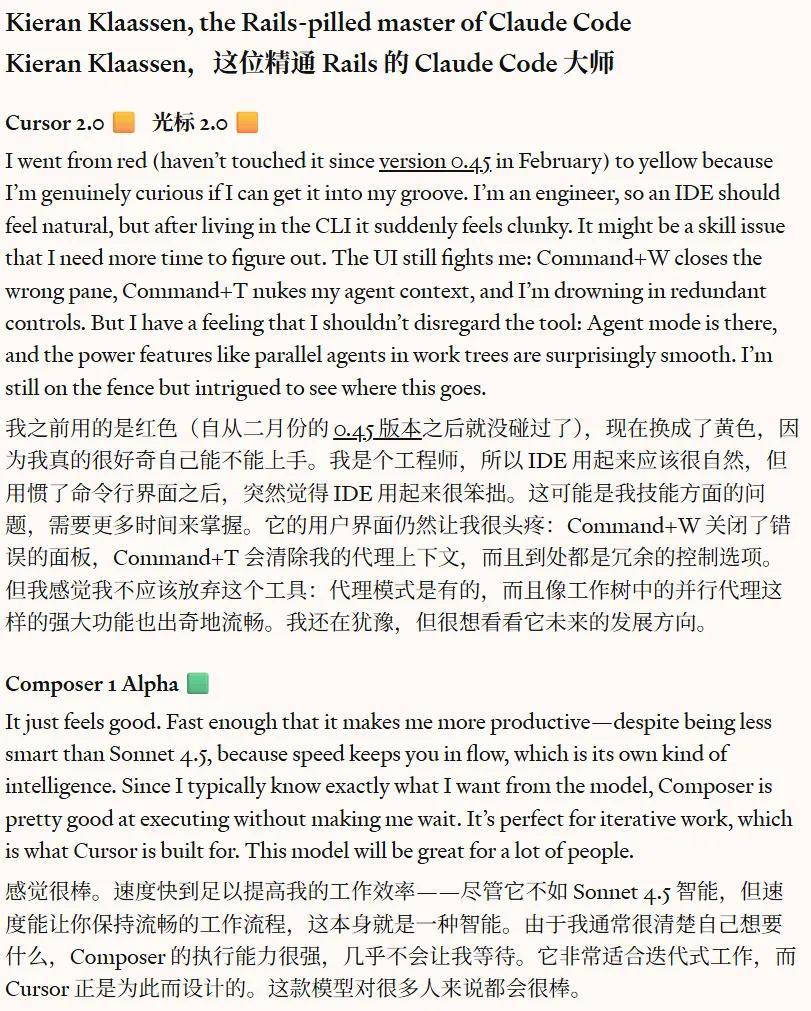

参与早期体验的开发者纷纷给予积极反馈。每个反馈都被 every.to 博客整理,其中包含了各种正反意见。

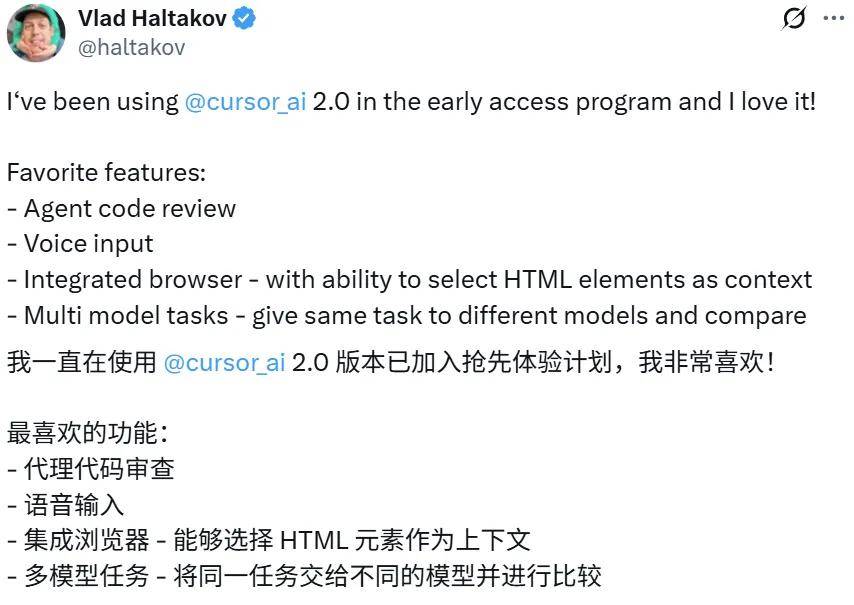

在X平台上,许多用户也分享了他们的使用体验。

有人甚至开玩笑建议让Cursor 2.0来创建AGI。

相关链接:

https://x.com/cursor_ai/status/1983567619946147967

https://cursor.com/blog/2-0

https://every.to/vibe-check/vibe-check-cursor-2-0-and-composer-1-alpha

https://cursor.com/cn/changelog/2-0

文中视频链接:https://mp.weixin.qq.com/s/SOYp-wIq3YE_DbgppqhALg